移动宽带 国外网站线上平面设计培训

Windows环境下Gin框架安装和配置

我终于搞定了Gin框架的安装,花了两三个小时,只能说道阻且长,所以写下这篇记录文章

先需要修改一些变量,这就需要打开终端,为了一次奏效,我们直接设置全局的:

setx GOPROXY 'https://mirrors.aliyun.com/goproxy/'

首先创建一个项目

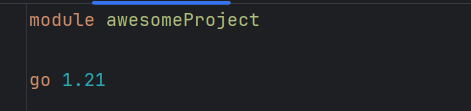

进去之后先创建go.mod文件,创建完之后通常会为你自动配置参数

然后我们打开Files->setting->go moudles,这样设置:

GOPROXY可以是自己配置的其他路径,通过终端查看方式:

go env

之后在GoLand里面打开终端,执行语句:

$env:GO111MODULE = "on"

然后安装:

go get -u github.com/gin-gonic/gin

安装完成之后,试以下程序:

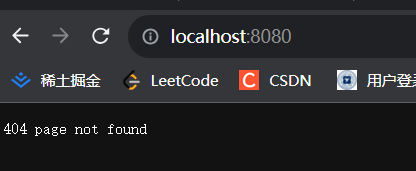

package mainimport ("github.com/gin-gonic/gin""net/http"

)func main() {r := gin.Default()r.GET("/ping", func(c *gin.Context) {c.JSON(http.StatusOK, gin.H{"message": "pong",})})r.Run() // listen and serve on 0.0.0.0:8080 (for windows "localhost:8080")

}

显示为:

整理完之后发现过程极其简单,但是自己却花了两个多小时,真是惭愧。