外贸门户网站建设选择网站的关键词

ER图(Entity-Relationship Diagram)是一种用于描述实体间关系的图形化表示方法。它主要用于数据库设计,可以清晰地展示实体、属性和实体间的联系。常用的ER图类型包括:

- 实体-关系模型(Entity-Relationship Model):用于表示实体(Entity)、属性(Attribute)和实体间的关系。

- 实体-关系图(Entity-Relationship Diagram):是实体-关系模型的图形化表示,更加直观和易于理解。

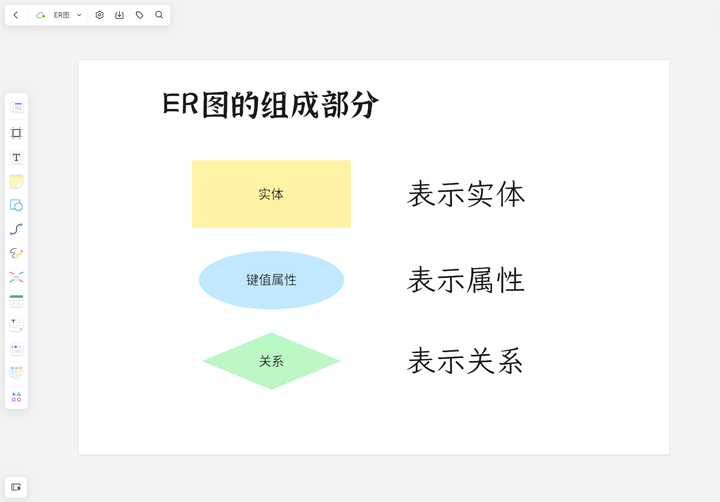

ER图主要由三个要素组成:

- 实体(Entity):表示现实世界中的一个对象、事物或概念,可以具有属性和标识符。

- 属性(Attribute):描述实体的特征或属性。每个实体可以有多个属性,如姓名、年龄、性别等。

- 关系(Relationship):表示实体之间的连接或联系。关系可以是一对一、一对多或多对多的关系。

常用的ER图绘制软件有很多,例如常见的Visio、Lucidchart等。但是,很多软件都需要下载到本地才能使用,或者需要一定的技能和经验才能上手。而现在有一款非常好用的绘图软件,可以在线绘制ER图,它就是boardmix博思白板。

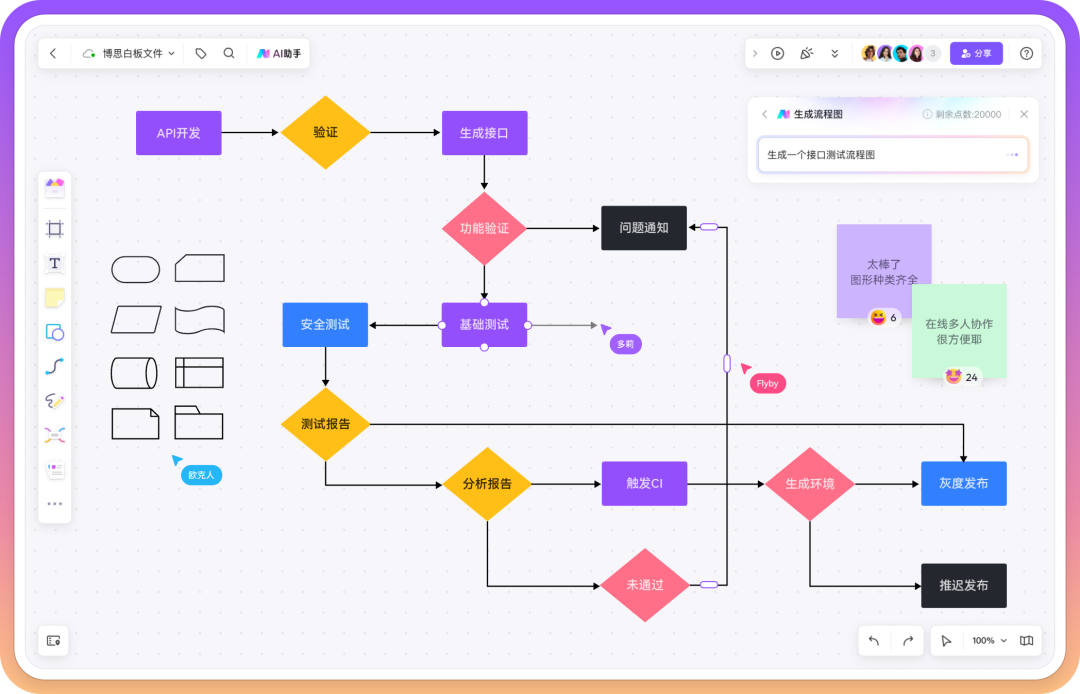

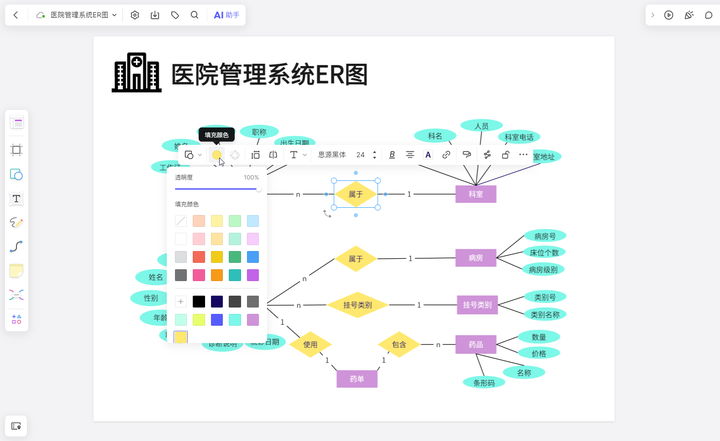

boardmix白板软件支持在线绘制ER图,无需下载,直接在网页上操作,极大地方便了用户。该软件支持多种标注、形状和箭头等绘制工具,集成了多种样式模板和图形库,同时还支持独创的智能布局和对齐方式,可以帮助用户快速设计和连接ER图上的实体、属性和关系。

使用boardmix白板软件绘制ER图时,用户可以自由调整ER图的布局和样式,保证ER图的美观性和可读性。同时,该软件支持多人协同在线绘制,不仅可以提高工作效率,还可以促进团队协作。

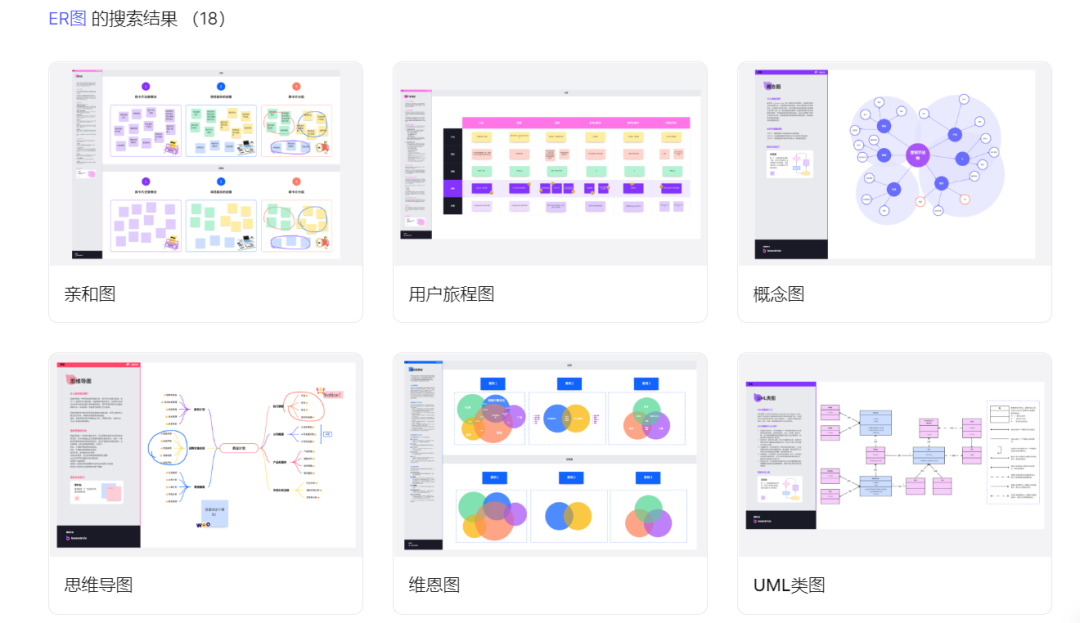

对了,boardmix白板软件还自带丰富的模板功能,在boardmix的模板中心中搜索ER图,就可搜索到很多种ER图类型,比如亲和图、概念图、维恩图、UML类图等,点击即可一键使用。

ER图是用于数据库设计中的一种非常有效和常用的数据建模方式。boardmix白板软件可以帮助用户在线绘制ER图,无需下载和学习软件,提高了绘图的效率和效果。不论是初学者还是专业人士,都可以轻松上手,推荐大家前去尝试一下。