如果做网站赚钱枣强网址建站

目录

前言:

一,安装

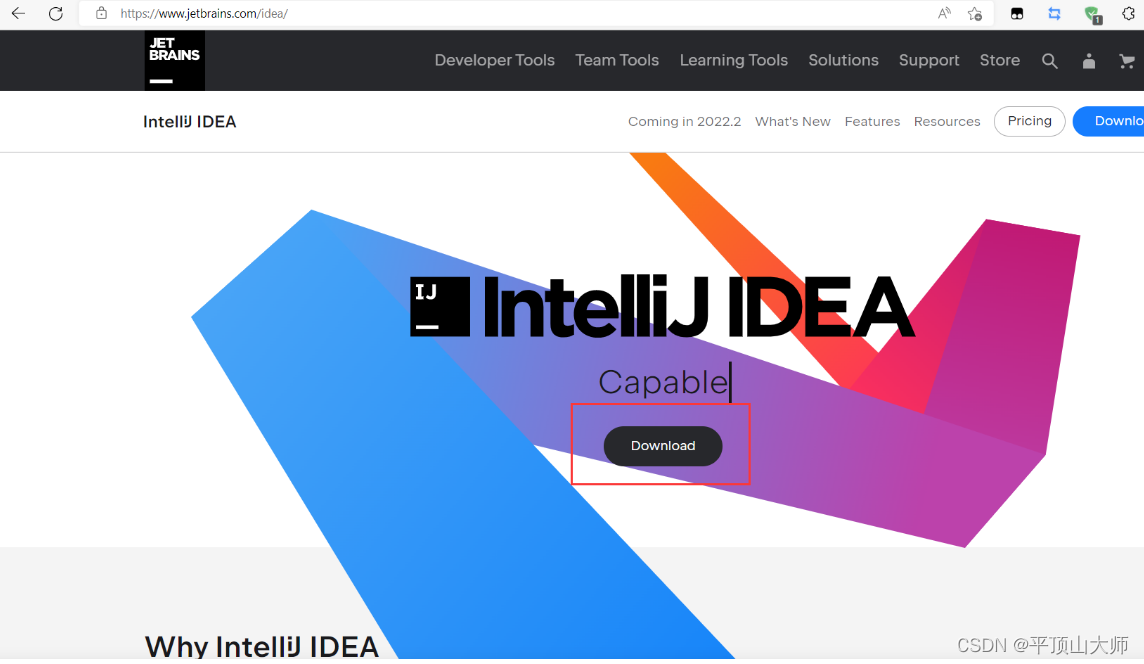

1.1打开官网JetBrains: Essential tools for software developers and teams点击 Developer Tools,再点击 Intellij IDEA

2.点击下载编辑

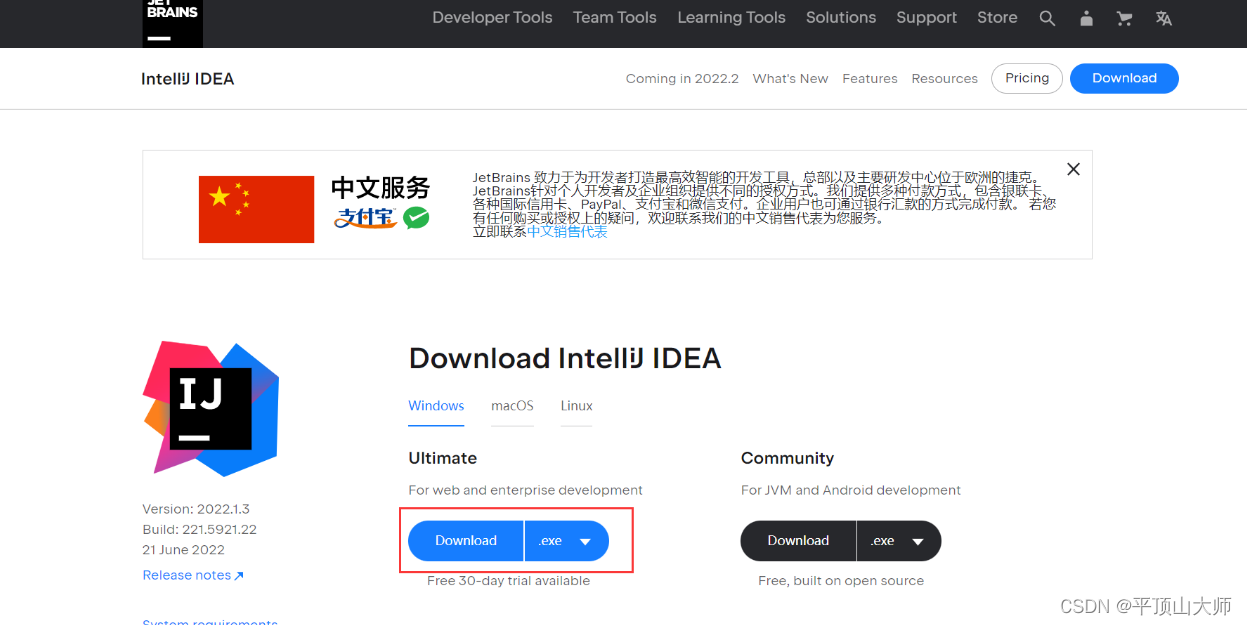

3.选择对应的版本,左边的 Ultimate 版本为旗舰版,需要付费,包括完整的功能。Community 版本为社区版,免费,只支持部分功能。这里我们选择左边 Ultimate 版本进行下载,然后进行激活

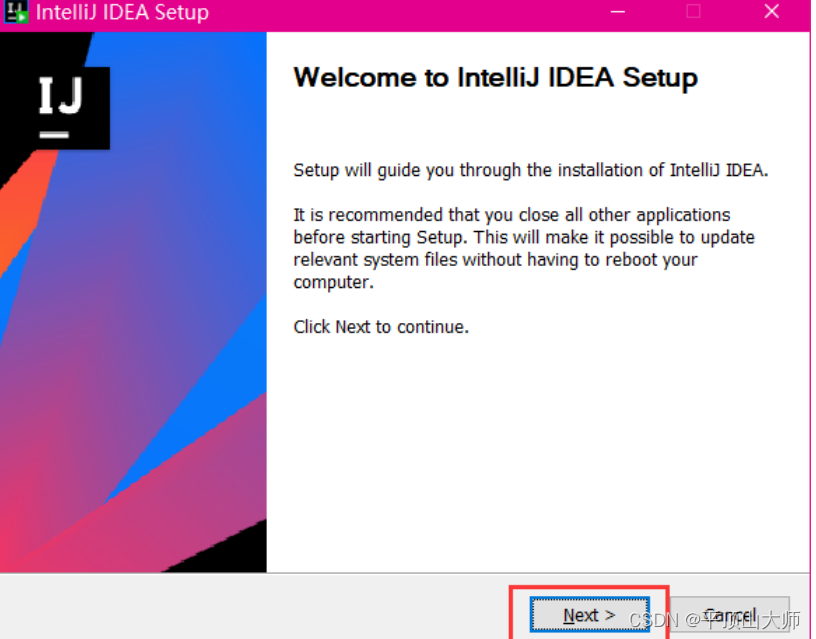

4.下完后运行安装

5.存放非中文目录下

6.配置信息(可以不用勾选)

7.默认继续

8.安装完成会自动打开IDEA

二,修改样式

2.1调节背景色

2.2设置鼠标悬浮提示

2.3显示方法分隔符

2.4忽略大小写提示

2.5设置字体

2.6配置类文档注释信息模版

2.7设置文件编码

2.8 水平或者垂直显示代码

2.9快捷方式改成eclipse

2.10设置默认浏览器

三,配置服务,构建Maven项目

3.1配置Tomcat服务

3.2构建Maven项目

前言:

今天为大家推荐一个IDEA。

一,安装

1.1打开官网JetBrains: Essential tools for software developers and teams点击 Developer Tools,再点击 Intellij IDEA

2.点击下载

3.选择对应的版本,左边的 Ultimate 版本为旗舰版,需要付费,包括完整的功能。Community 版本为社区版,免费,只支持部分功能。这里我们选择左边 Ultimate 版本进行下载,然后进行激活

4.下完后运行安装

继续

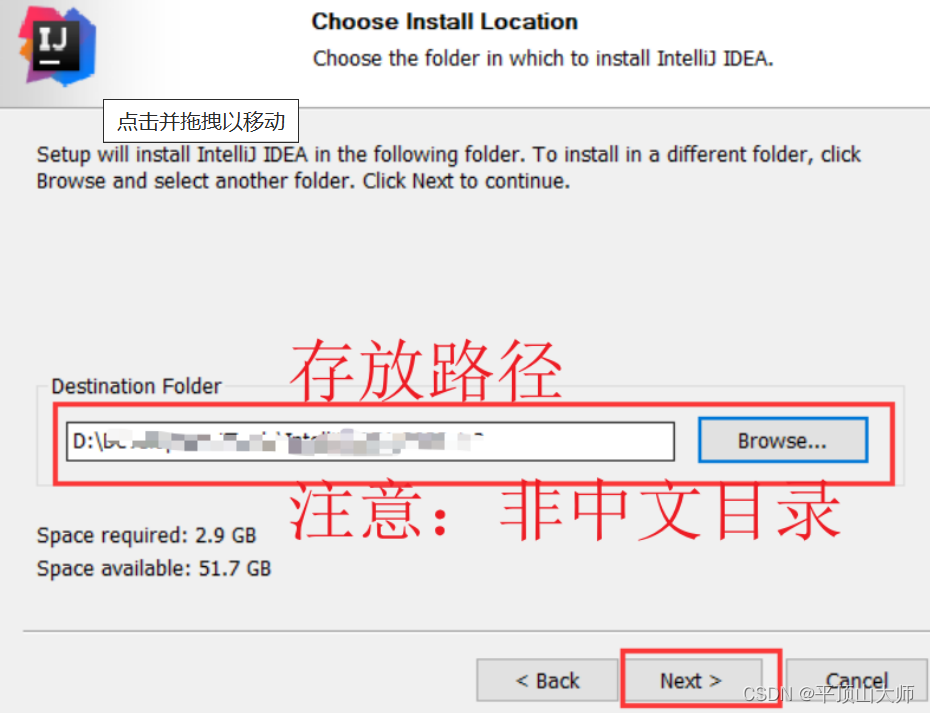

5.存放非中文目录下

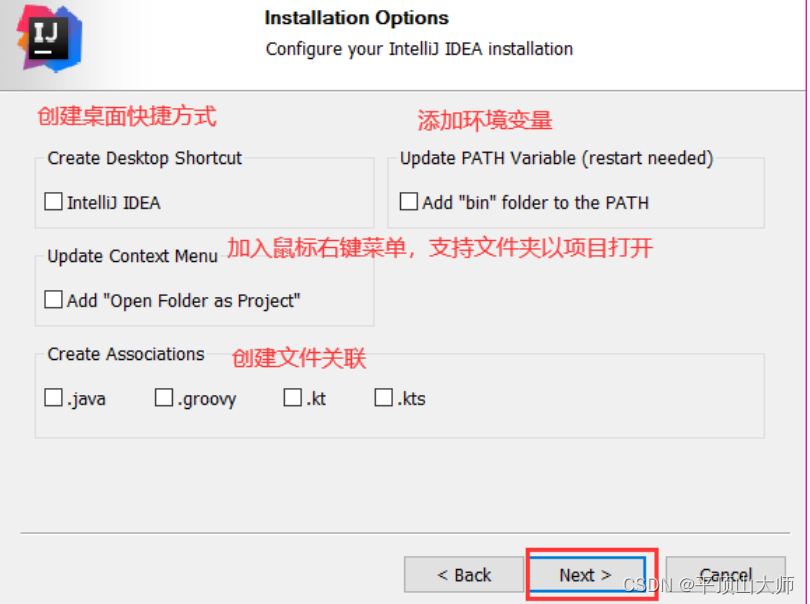

6.配置信息(可以不用勾选)

7.默认继续

8.安装完成会自动打开IDEA

二,修改样式

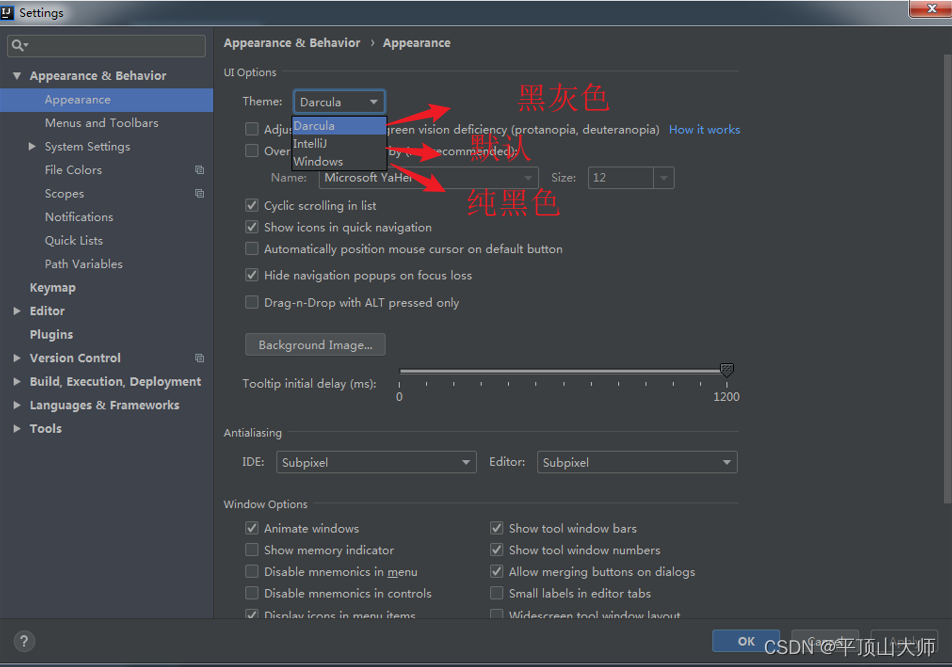

2.1调节背景色

File→settings→Appearance

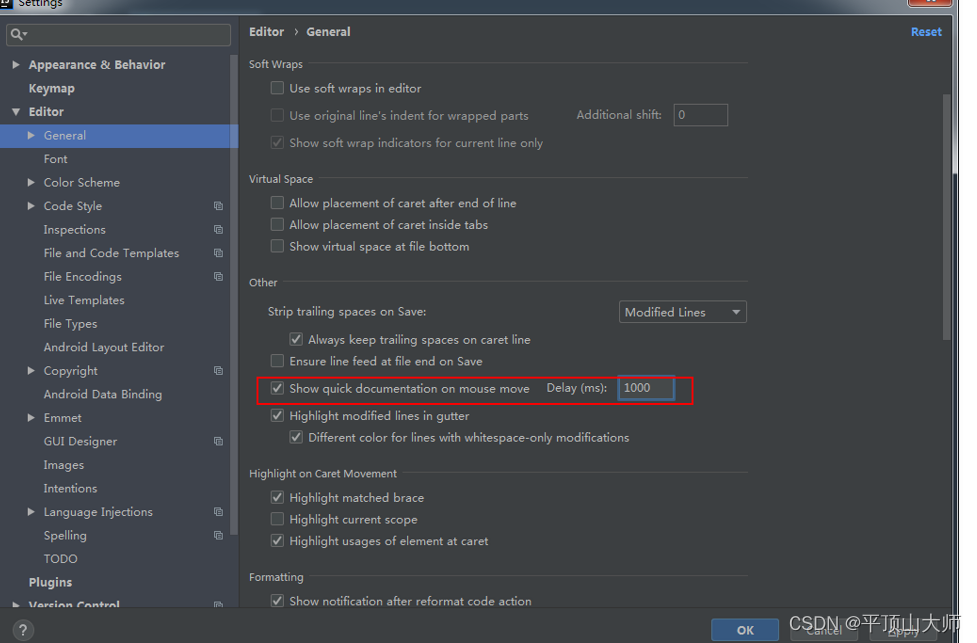

2.2设置鼠标悬浮提示

File→settings→Editor→General

这里我们要勾选下,后面设置的是延迟时间 默认半秒,这里我们设置1s;

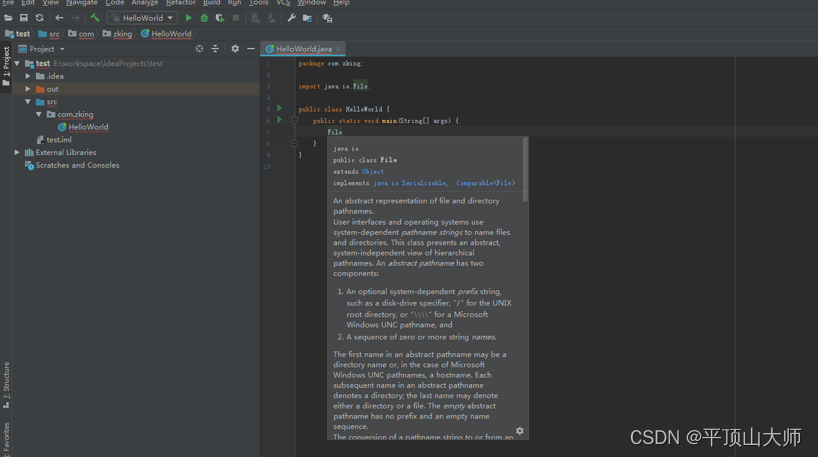

设置后,我们鼠标移动到类上看看;

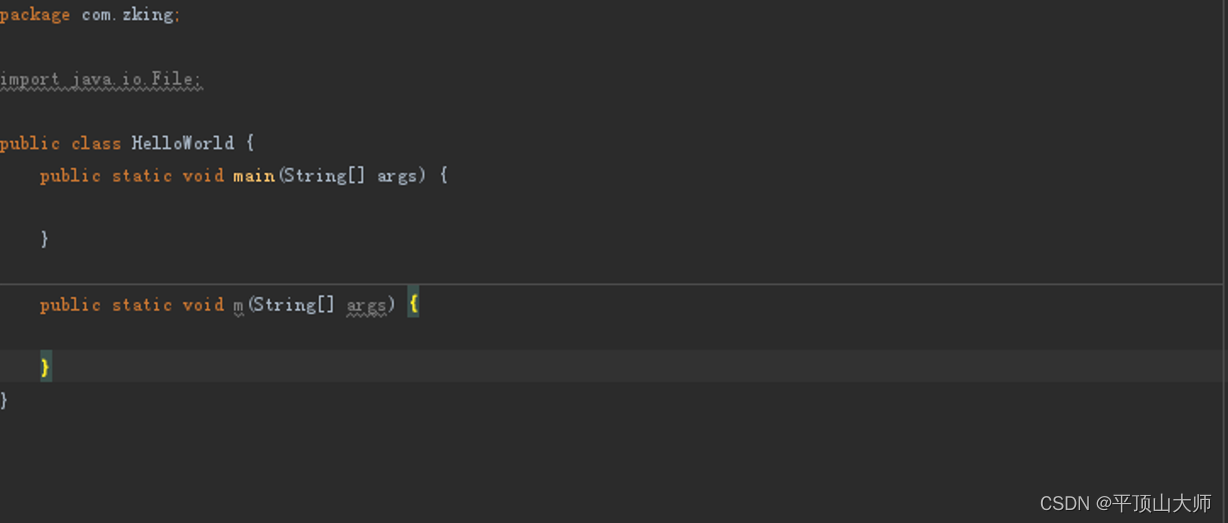

2.3显示方法分隔符

Editor→General →Appearance

上下就有分隔符出现,方便查看代码;

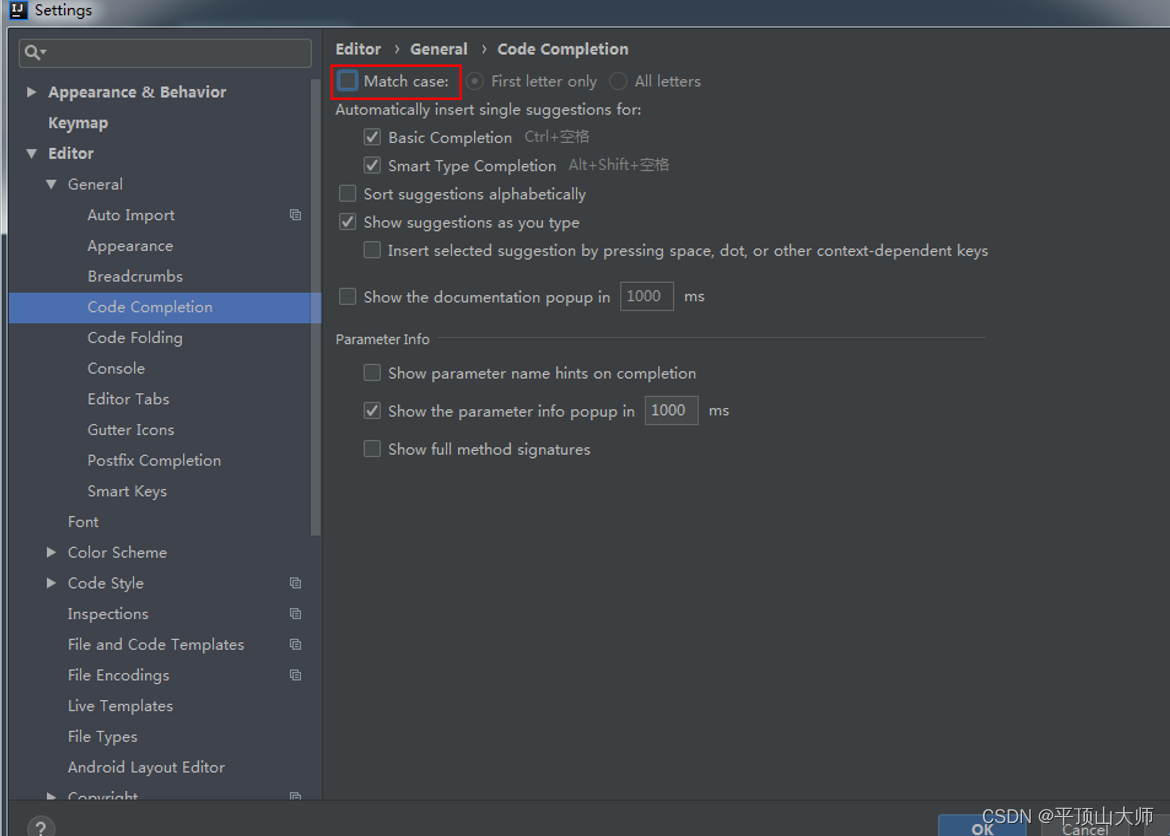

2.4忽略大小写提示

Editor → General → Code Completion

2.5自动导包

Editor → general → Auto Import

下拉选All 然后下面两个勾选下即可;随后可以自动导入包,取消导包。

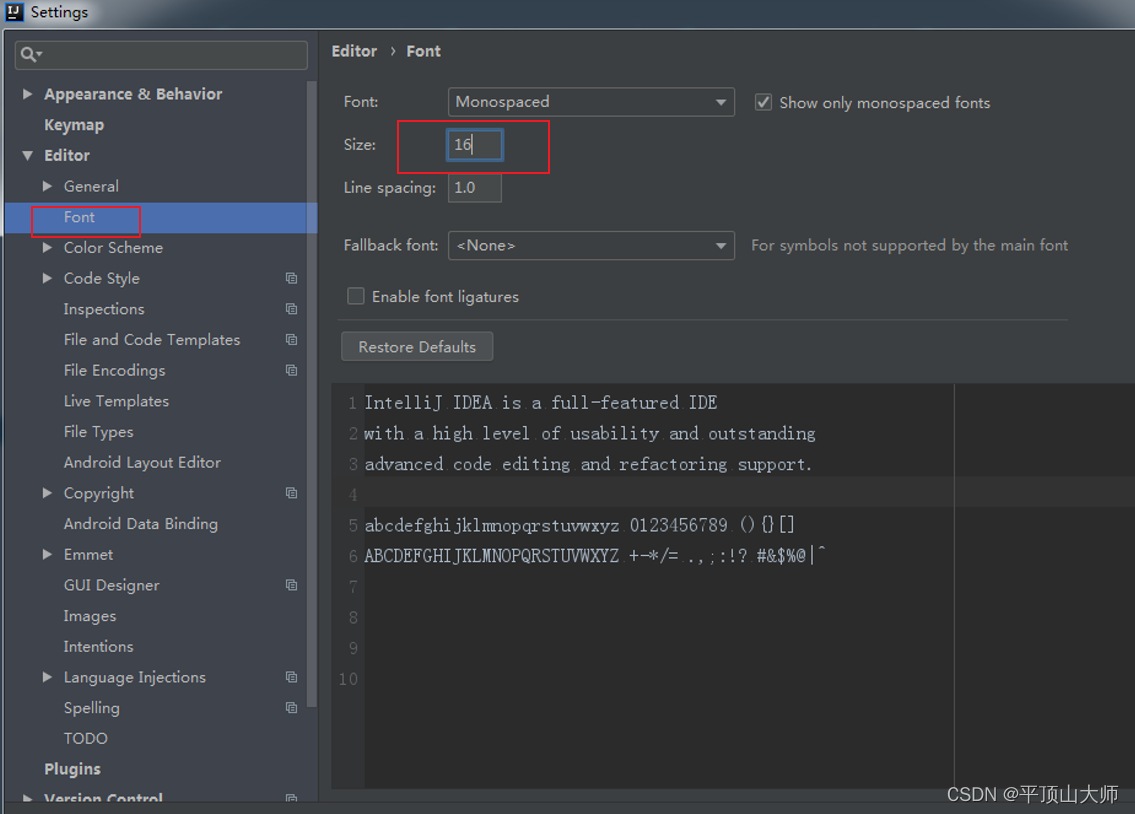

2.5设置字体

Editor->Font

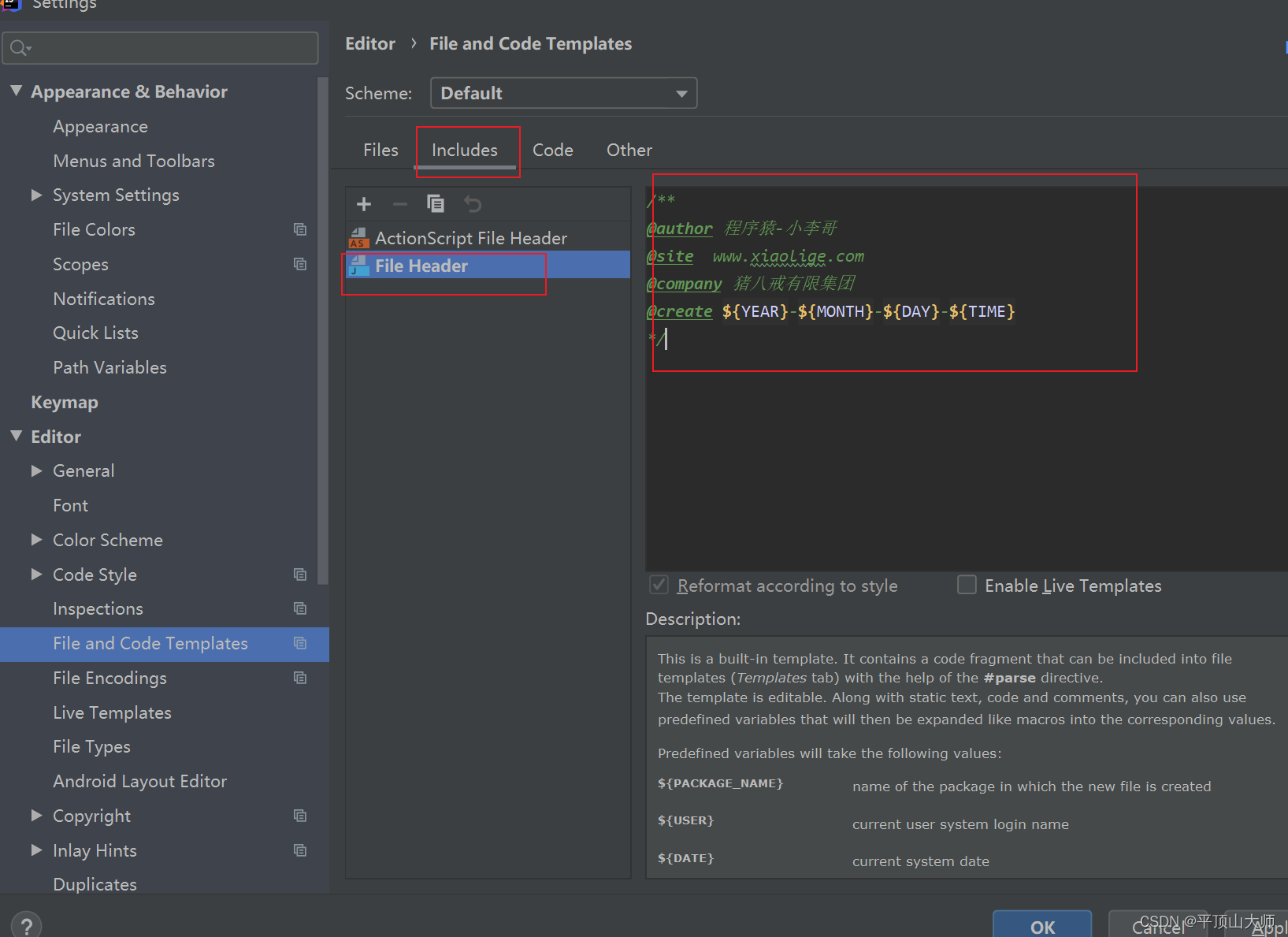

2.6配置类文档注释信息模版

File → Settings → Editor →File and Code Templates → Includes →File Header

我们加上:

/**

@author

@site

@company

@create ${YEAR}-${MONTH}-${DAY} ${TIME}

*/

2.7设置文件编码

File → Settings → Editor → File Encodings

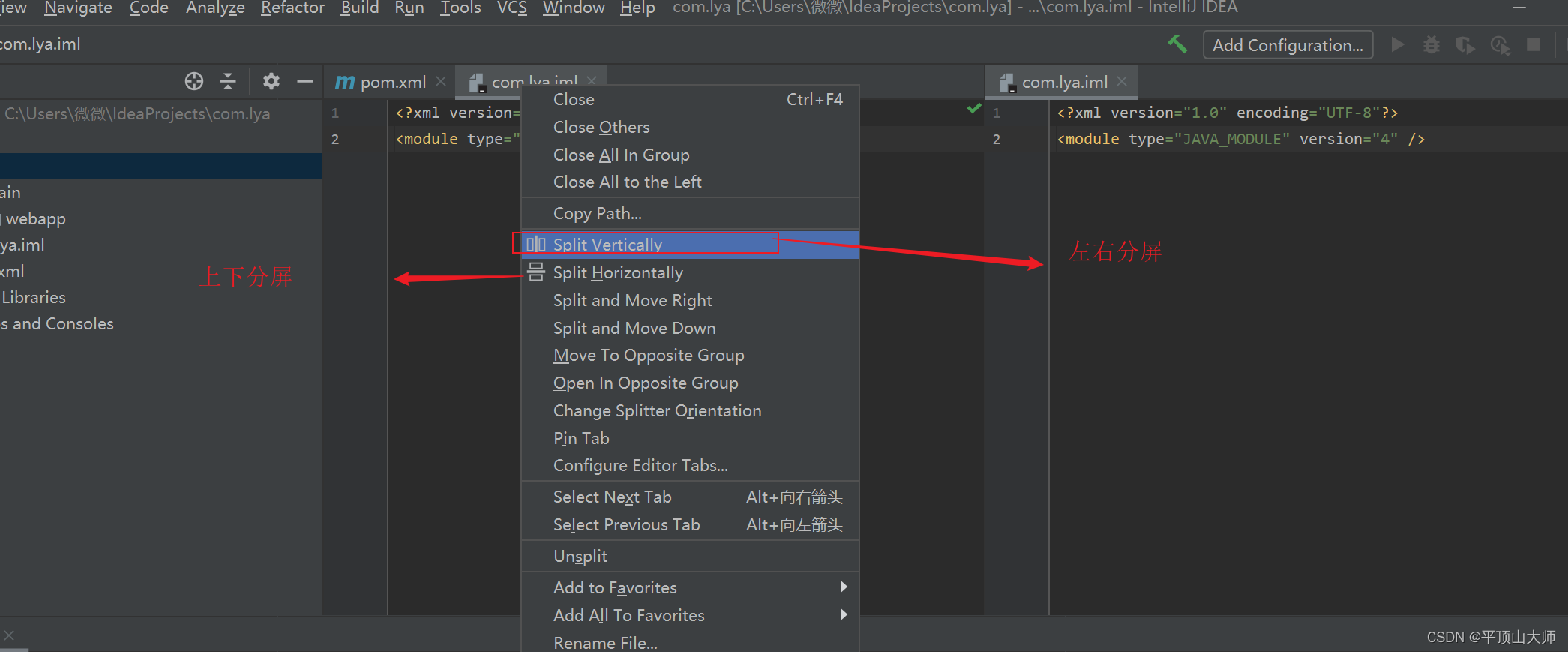

2.8 水平或者垂直显示代码

IDEA不像这里eclipse不能够直接脱拉

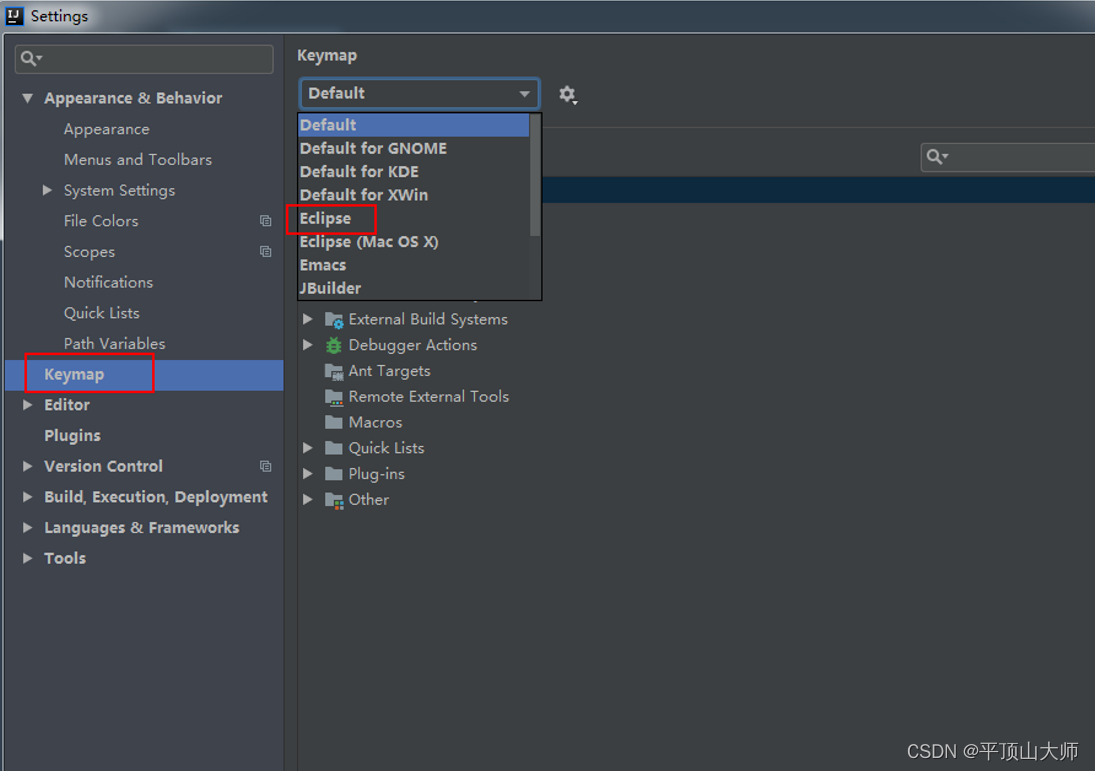

2.9快捷方式改成eclipse

File → Settings → Keymap

2.10设置默认浏览器

File → Settings → Tools → Web Browsers

中间的最下面选择 First Listd

三,配置服务,构建Maven项目

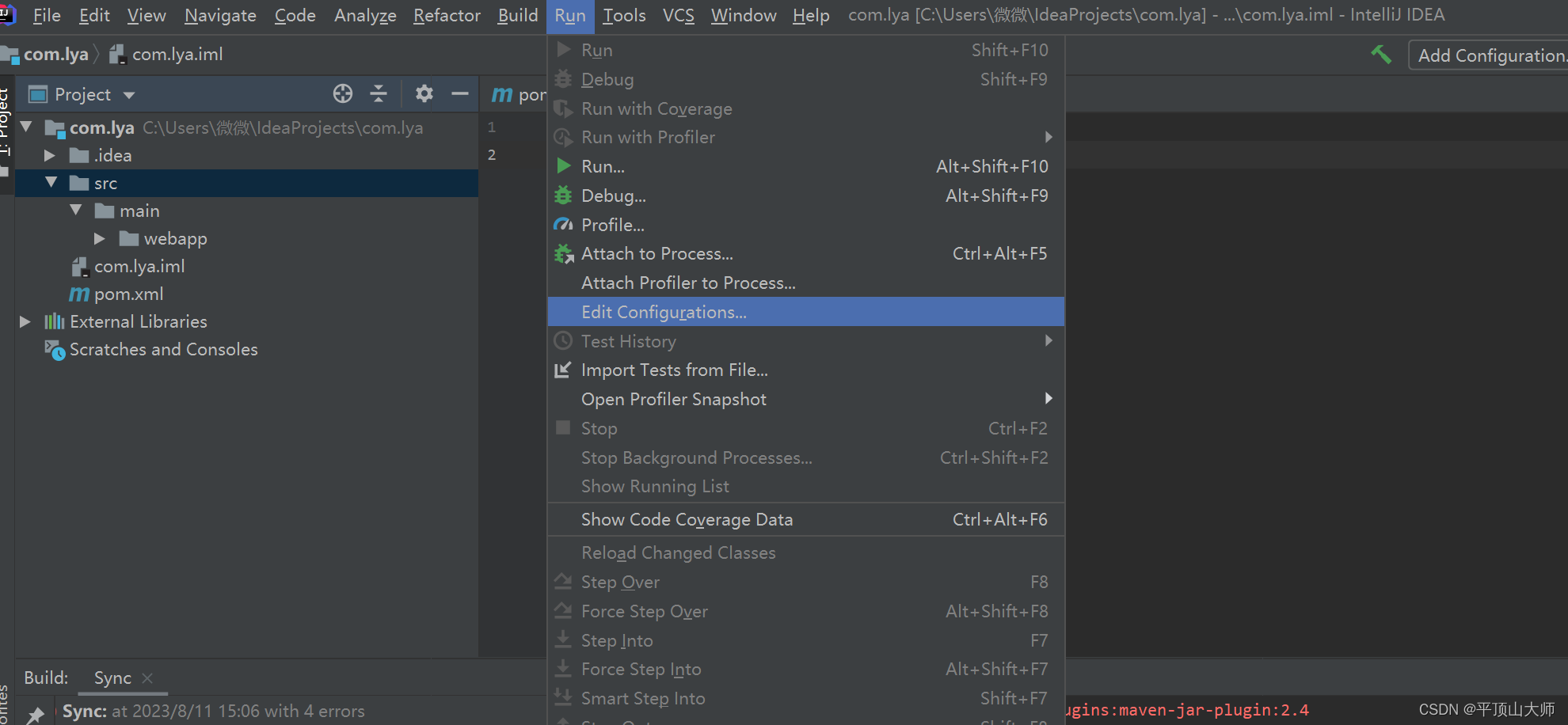

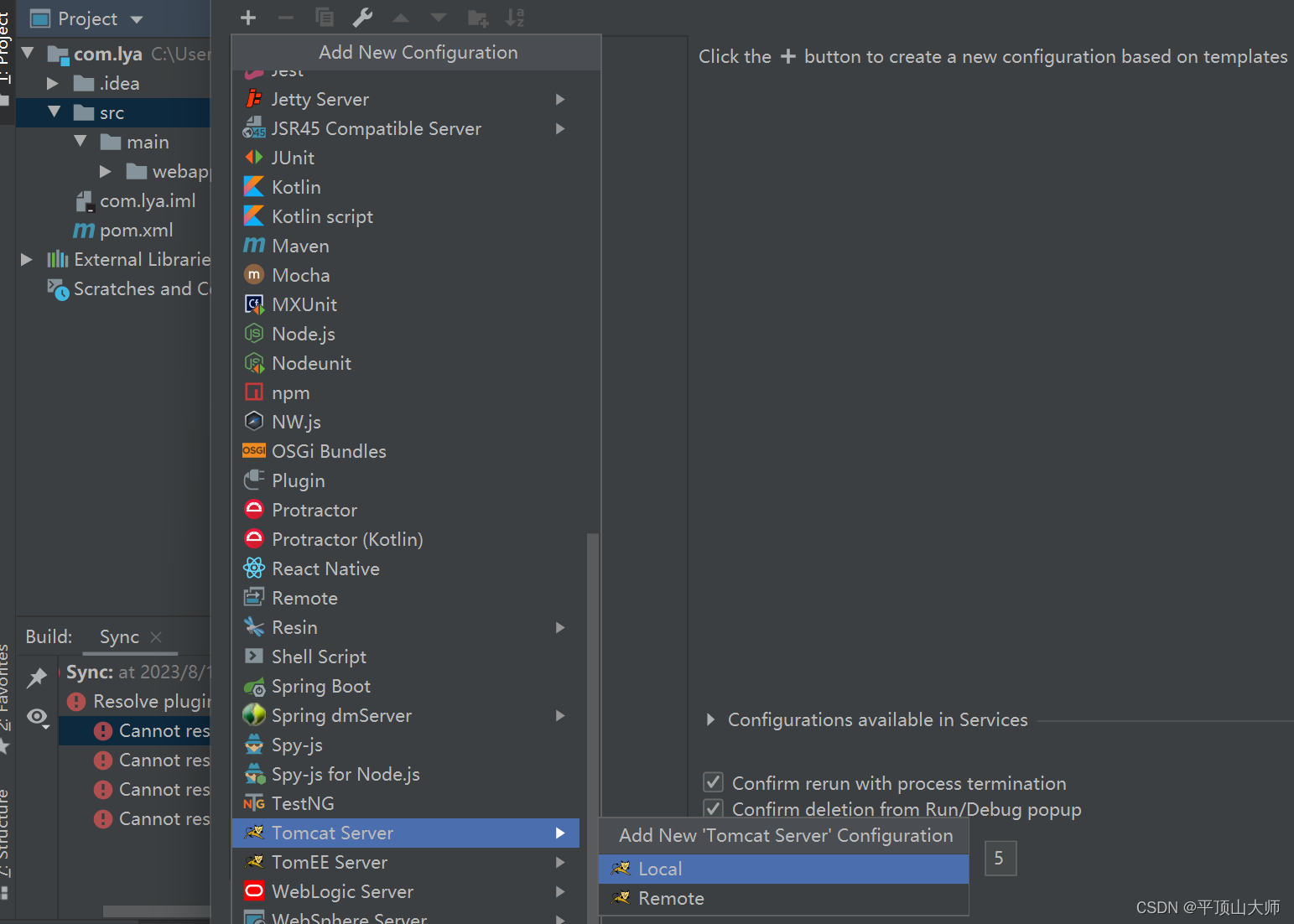

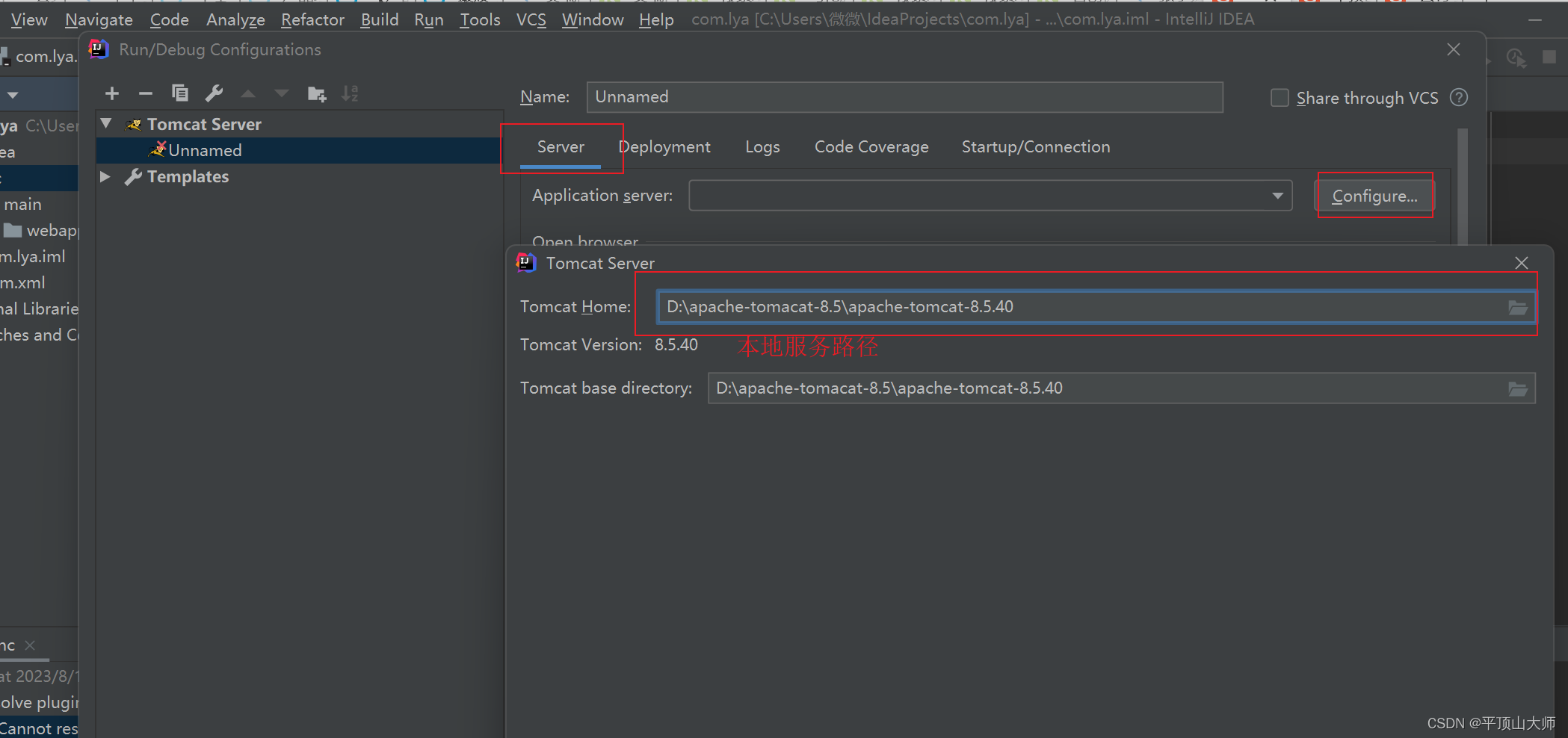

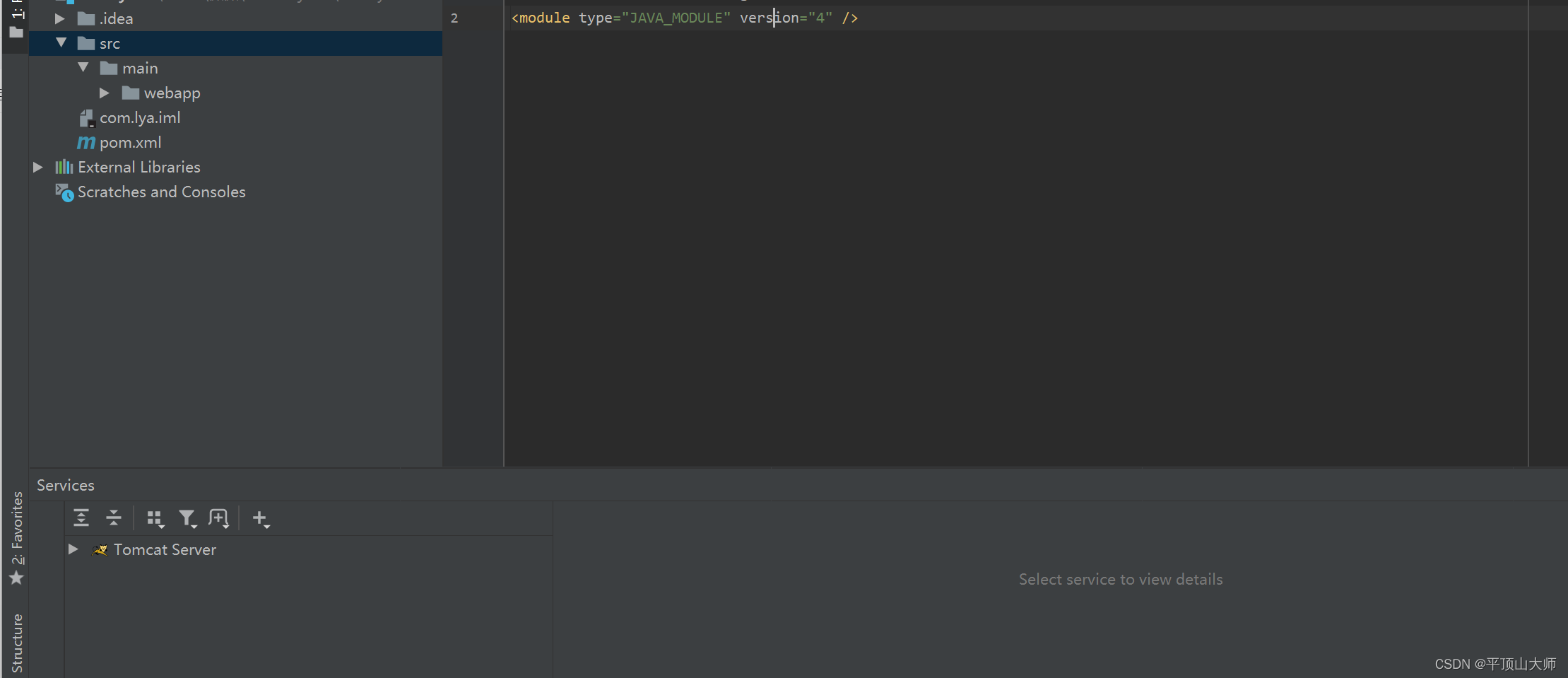

3.1配置Tomcat服务

找到Run → Edit Configurations → + → more →Tomcat Server → Local

配置OK了

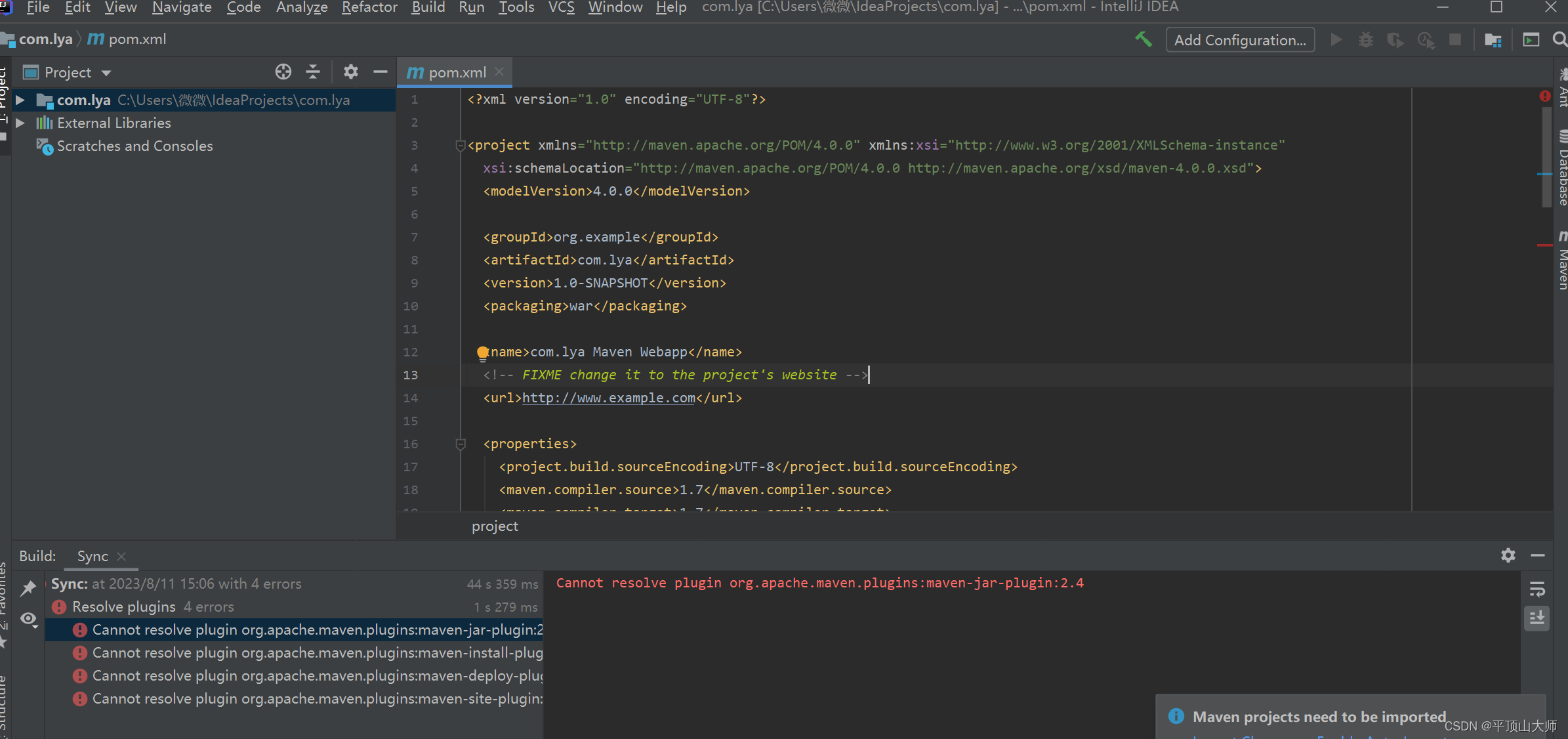

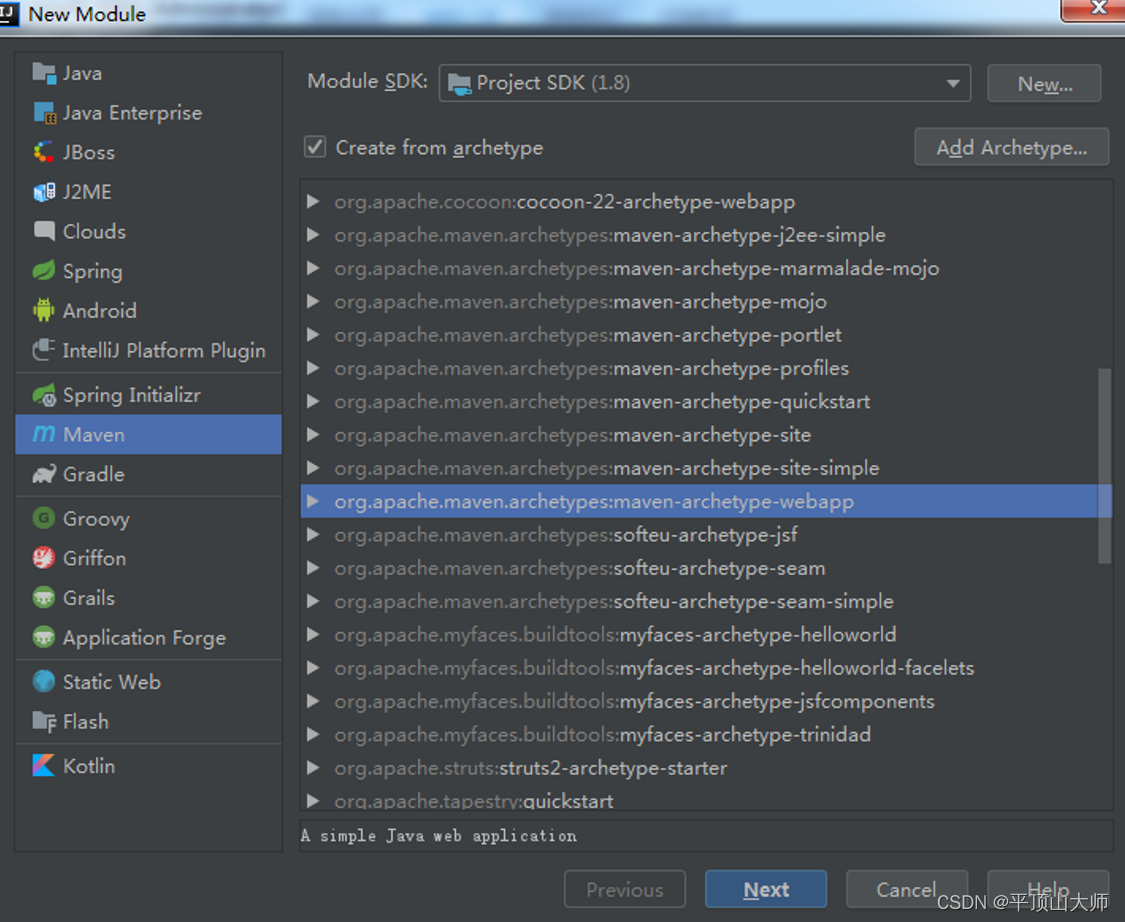

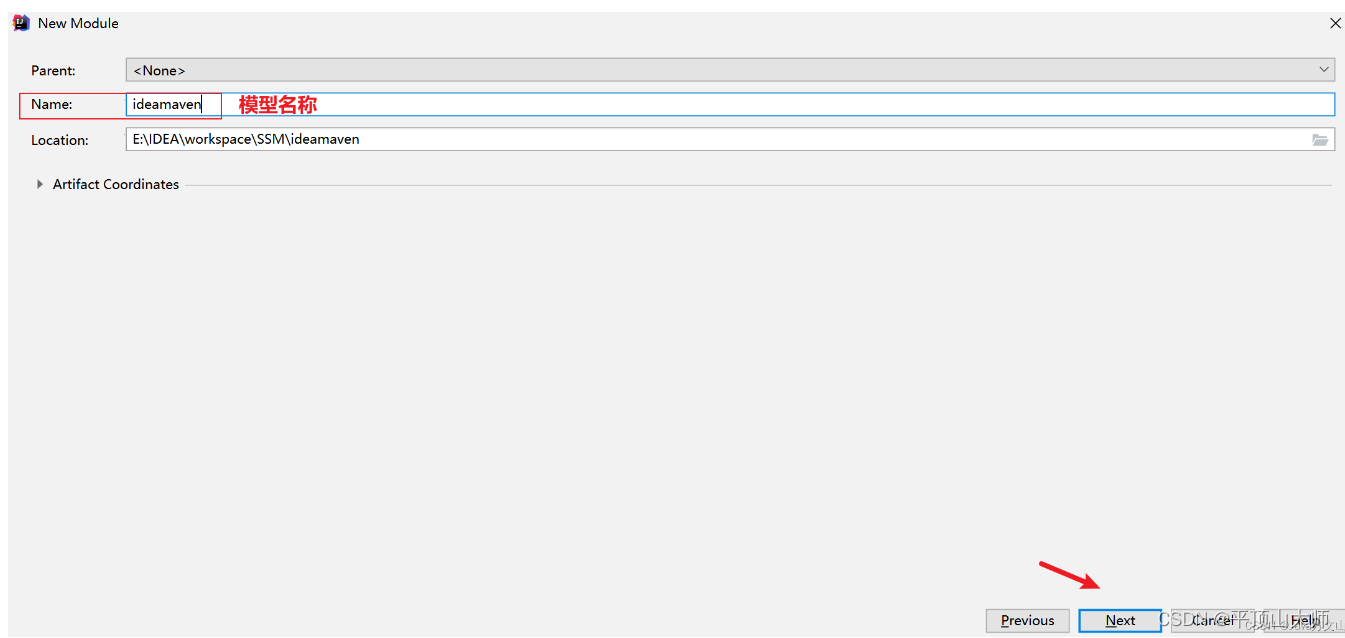

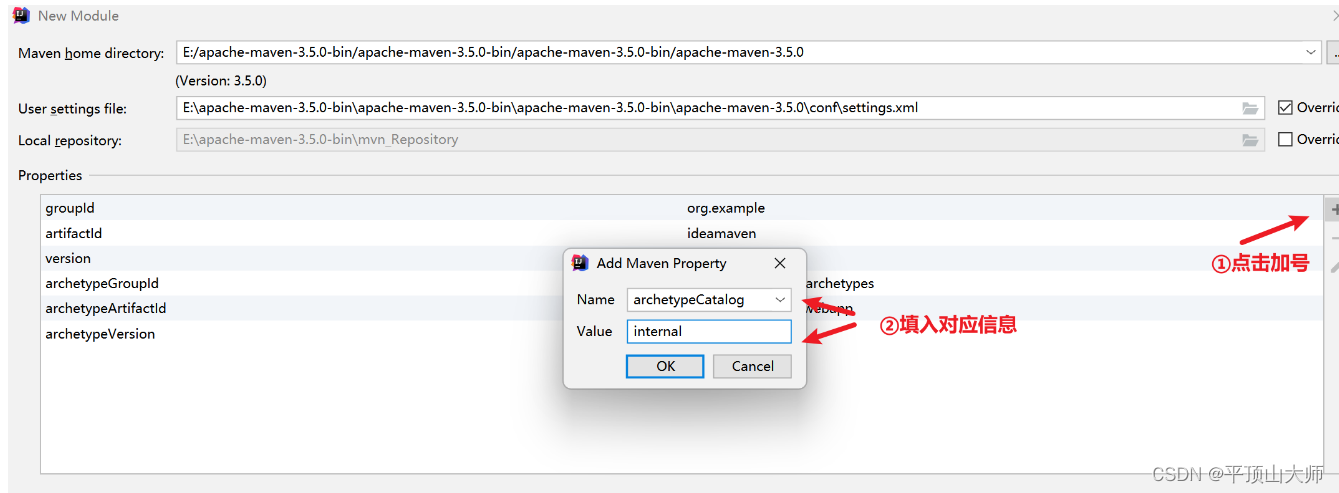

3.2构建Maven项目

1.新建项目

2.为项目起名

3.配置maven

4.pom.xml配置依赖,Maven插件

依赖字符串:

<dependency>

<groupId>junit</groupId>

<artifactId>junit</artifactId>

<version>4.12</version>

<scope>test</scope>

</dependency><dependency>

<groupId>mysql</groupId>

<artifactId>mysql-connector-java</artifactId>

<version>5.1.44</version>

</dependency><dependency>

<groupId>javax.servlet</groupId>

<artifactId>javax.servlet-api</artifactId>

<version>4.0.1</version>

<scope>provided</scope>

</dependency>Maven插件:

<plugin>

<groupId>org.apache.maven.plugins</groupId>

<artifactId>maven-compiler-plugin</artifactId>

<version>3.7.0</version>

<configuration>

<source>1.8</source>

<target>1.8</target>

<encoding>UTF-8</encoding>

</configuration>

</plugin>

5.web.xml从2.3版本换成3.1

<web-app xmlns="http://xmlns.jcp.org/xml/ns/javaee"

xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://xmlns.jcp.org/xml/ns/javaee http://xmlns.jcp.org/xml/ns/javaee/web-app_3_1.xsd"

version="3.1">

现在我们建一个jsp,servelet页面去测试以下