东营seo网站推广费用合肥网页制作联系方式

刚刚在Windows10上搭建环境来对llama2做finetune,里面坑还是挺多的,这里把印象中的坑整理了一下以作备忘。

llama-recipes是meta的开源项目,Github地址为:GitHub - facebookresearch/llama-recipes: Examples and recipes for Llama 2 model

llama2同样也是meta的开源LLM模型,因此用此项目做finetune应该是正确的方向;

模型的选择

模型在自然是在huggingface上下载到的,上面的模型很多,因此您也有很多选择。程序加载模型采用了torch因此需要选择带有pytorch-xxx.bin的目录。本人选择的是daryl149/llama-2-7b-chat-hf(daryl149/llama-2-7b-chat-hf · Hugging Face)

数据集选择

默认数据集是samsum_dataset;使用这个数据集的目标是为一段文字做总结。本人的模型微调目标是问答,所以使用了模型提到的另一个数据集:stanford的alpaca_dataset(文本数据21.7 MB)。

数据集请见:Stanford CRFM

这里我是用项目自带的notebook “quickstart”来一步步执行的,所以我们需要在代码中对数据集进行调整

train_dataset = get_preprocessed_dataset(tokenizer, alpaca_dataset, 'train')依赖包下载

依赖包下载比较麻烦,这里是坑最多的地方;国内的网速是一方面,类库对Windows系统的支持是另一方面。

国内镜像加速

很庆幸在互联网上找到了这个清华的源,在pip安装的时候可以加上参数:

pip install -r requirements.txt -i https://pypi.tuna.tsinghua.edu.cn/simple --trusted-host pypi.tuna.tsinghua.edu.cn

torch的下载

我这边经过requirement下载的默认是CPU版本的(😓)

需要卸载并安装GPU版本的,本人目前没有调通CPU版本的程序(从实际角度来说,也是GPU在真实场景下使用概率更高)。如何在安装请参考Start Locally | PyTorch

这里我通过CONDA,装的是CUDA11.8

conda install pytorch torchvision torchaudio pytorch-cuda=11.8 -c pytorch -c nvidia

一步步处理缺失的包

这里大概就是缺什么包就装什么包

有一点需要额外关注的,就是程序识别不到GPU

这种情况一是安装了CPU版本的pytorch,在前面提到了解决方法;还有一种可能是bitsandbytes的问题;

在Windows10中,我最后同时安装了bitsandbytes 0.39.0版本和bitsandbytes-Windows 0.37.5版本;

同时参考了这篇文章:win11下bitsandbytes的用法 – yinfupai

我仅仅是将main.py 中的evaluate_cuda_setup() 函数做了修改,如下:

#return binary_name, cudart_path, cuda, cc, cuda_version_string

return "libbitsandbytes_cuda118.dll", None, None, None, None我安装的cuda版本是11.8,因此做如上修改;

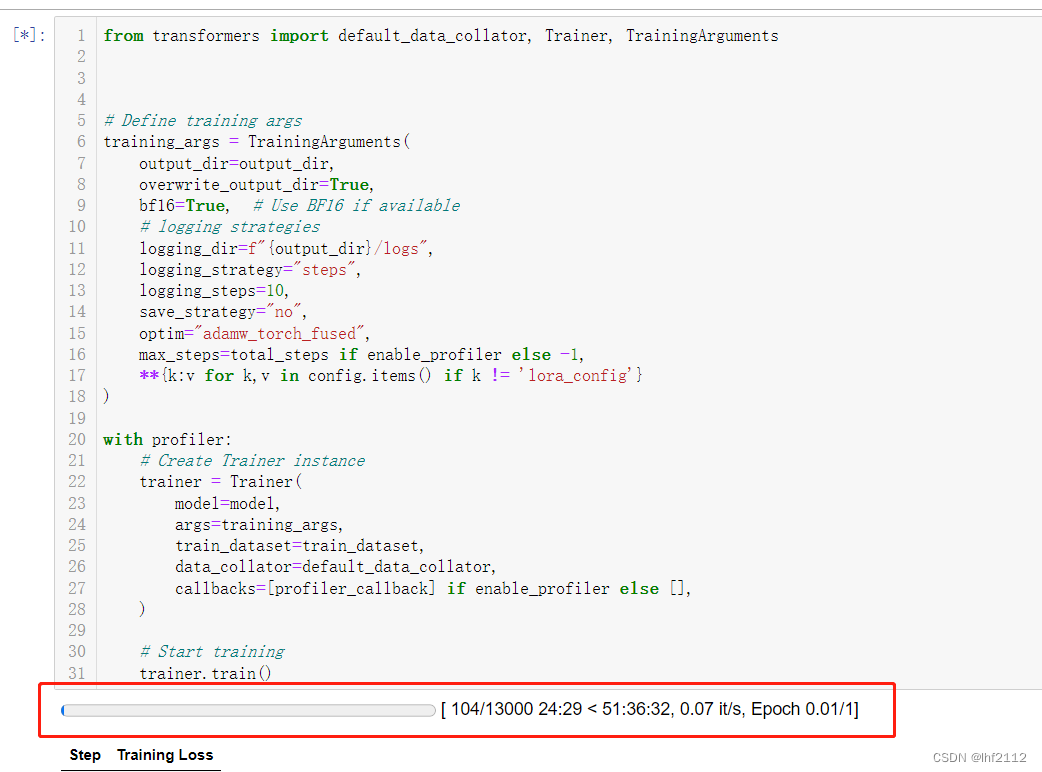

运行程序

在我的机器上运行一个epoch要50多个小时(😓),想要发挥作用还是需要更好的算力支持啊!