建设网站需要什么内容京东采取了哪些网络营销方式

QT信号与槽机制

1、信号(signal): 所谓信号槽 (观察者模式)信号本质是事件。信号展现方式就是函数。当某一个事件发生之后,则发出一个信号(signal).

2、槽(slot): 就是对信号响应的函数,槽就是一个函数。槽函数与普通函数区别槽函数可以与一个信号关联,当信号被发射的时候,关联的槽函数被自动执行处理。信号与槽关联是使用 QObject::connect0函数进行实现。

信号函数只需要声明(不需要定义(实现) )而槽函数需要定义 (实现信号和槽机制底层是通过函数之间进行相互调用实现的。每个信号都可以用函数来表示,称为信号函数; 每个槽也可以用函数表示,称为槽函数槽函数可以使用 public slots/protected slots/private slots 修饰。signals和 slots 是 Qt 开发当中在 C++语言基础之上扩展的关键词,专门用于指明信号函数和槽函数

QObject::connect(......):

- 参数 1sender: 发出信号的对象;

- 参数 2signal:sender 对象的信号

- 参数 3receiver: 信号接收者

- 参数 4method: receiver 对象的槽函数,当检测到 sender 信号,receiver

- 对象调用 method 方法

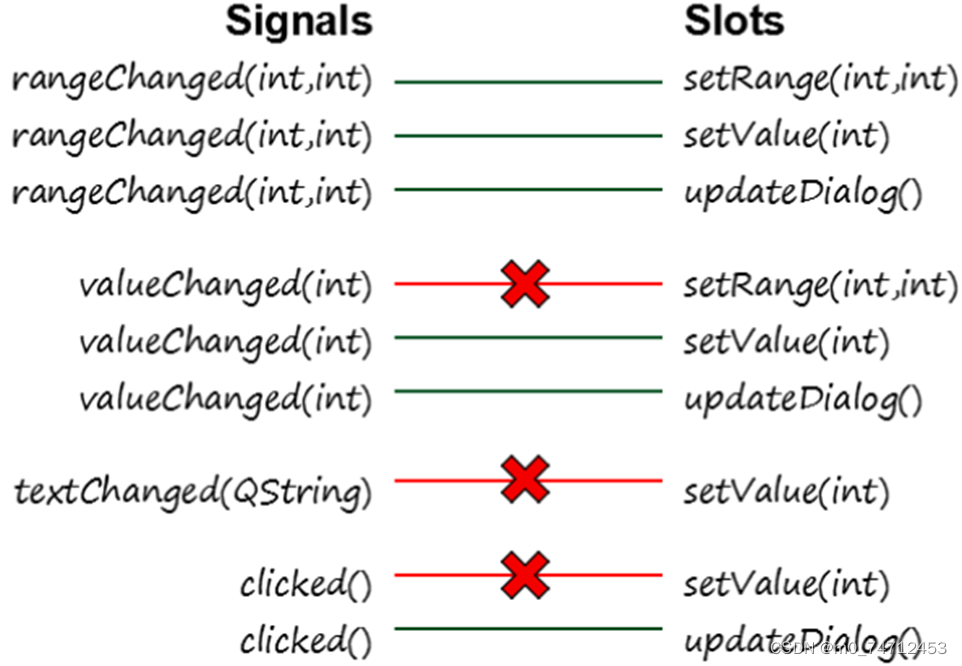

3、信号与槽机制连接方式

一个信号可以跟另一个信号相连

conect(object1,SIGNAL(signal1),object2,SIGNAL(signal1))

同一个信号可以跟多个槽相连

conect(object1,SIGNAL(signal2)object2,SIGNAL(slot2));

conect(object1,SIGNAL(signal2),object3,SIGNAL(slot1))

同一个槽可以响应多个信号

conect(object1,SIGNAL(signal2),object2,SIGNAL(slot2))

conect(object3,SIGNAL(signal2)object2,SIGNAL(slot2));

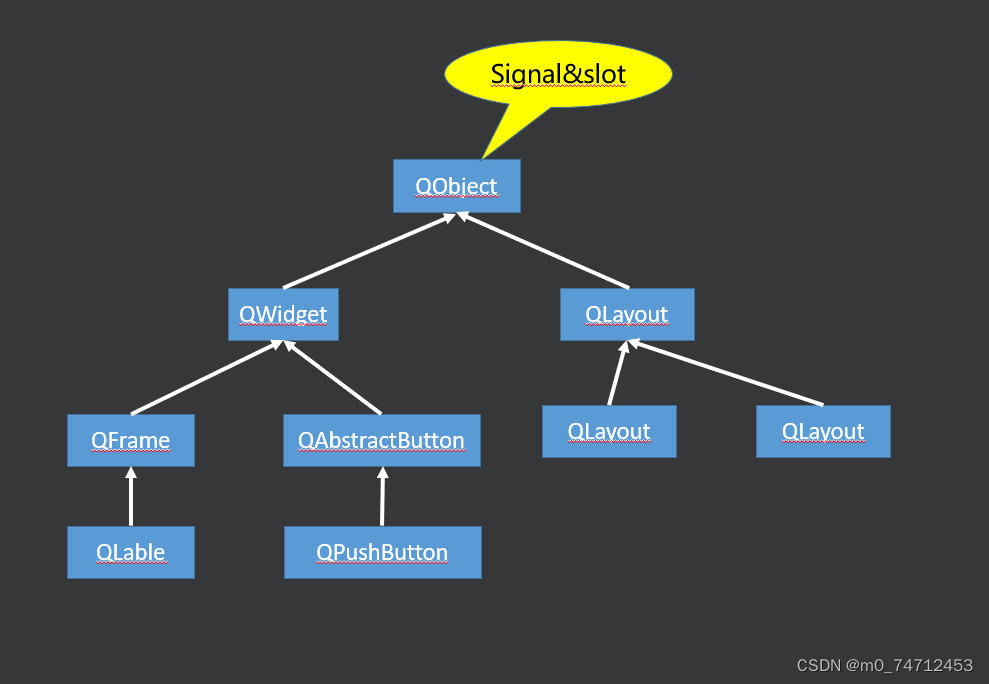

4、信号和槽机制优势: 松散羯合:类型案例。一个类若要支持信号

和槽,就必须从 QObiect 或 QObect 的子类继承。Qt 信号和槽机制不支持对模板的使用

5、信号与槽机制效率: 增强对象的之间通信的灵活性,但是也会损失一些性能。通过传递一个信号来调用槽函数将会比直接调用非虚函数运行速度慢,主要原因:

- 多线程的时候,信号可能需要排队等待

- 编组/解组传递的参数

- 安全地遍历所有的关联

- 需要定位接收信号的对象

GUI继承简介

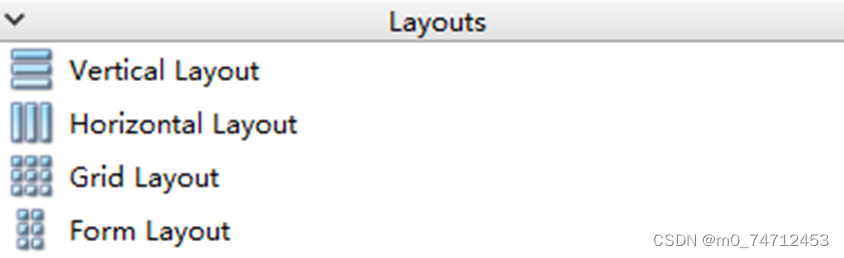

布局管理器

- 垂直布局

- 水平布局

- 网格布局

- 表单布局

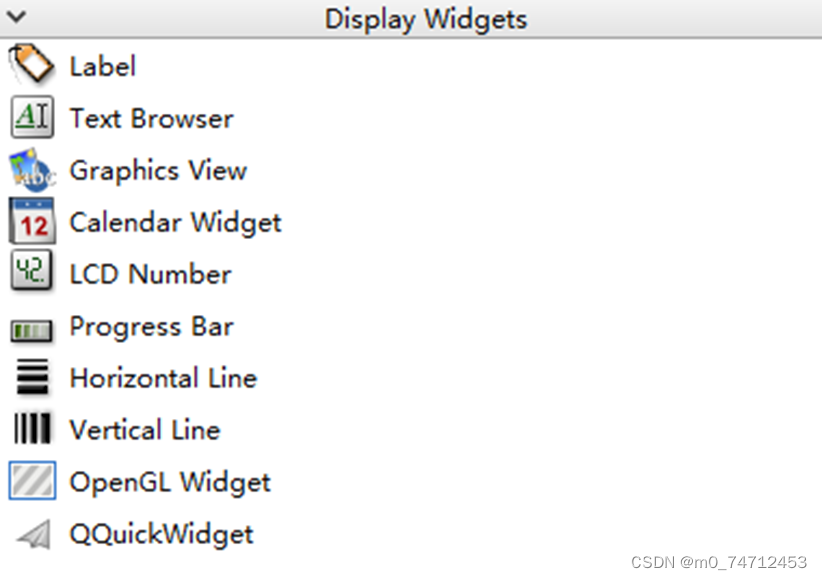

输出控件

- Label: 标签

- Text Browser: 文本浏览器

- Graphics View : 图形视图框架

- Calendar Widget: 日历控件

- LCD Number: 液晶字体数字控件

- Progress Bar: 进度条

- Horizontal Line/Vertical Line: 水平线/垂直线

- OpenGL Widget : (Open Graphics Library) 图形渲染控件

- QQuickWidget : QML 嵌入控件

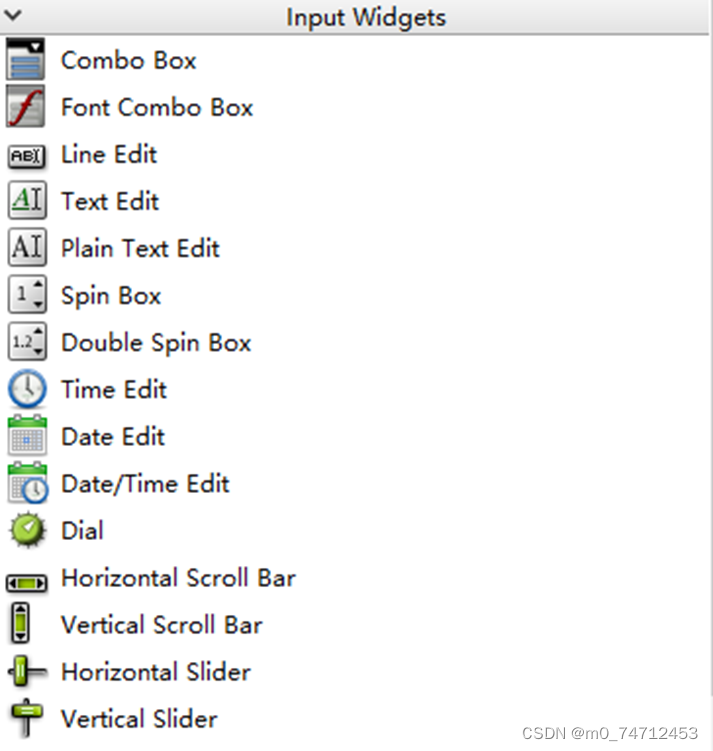

输入控件

- 编辑组合框

- 字体组合框

- 行编辑框

- 文本编辑

- 多行文本编辑

- 整数旋转框

- 小数旋转框

- 时间编辑

- 日期编辑

- 时间/日期编辑

- 表盘控件

- 水平滚动条

- 垂直滚动条

- 水平滑动条

- 垂直滑动条

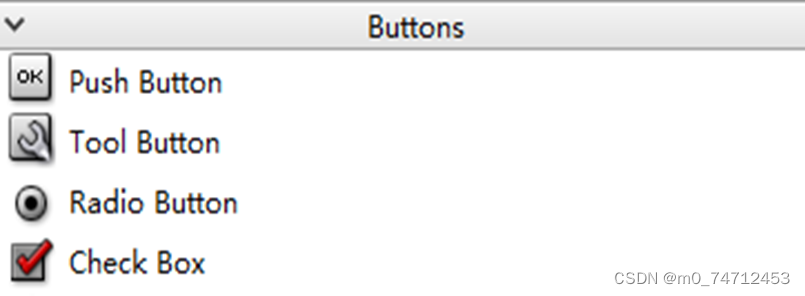

按钮

- 按钮

- 工具按钮

- 单选按钮

- 复选框

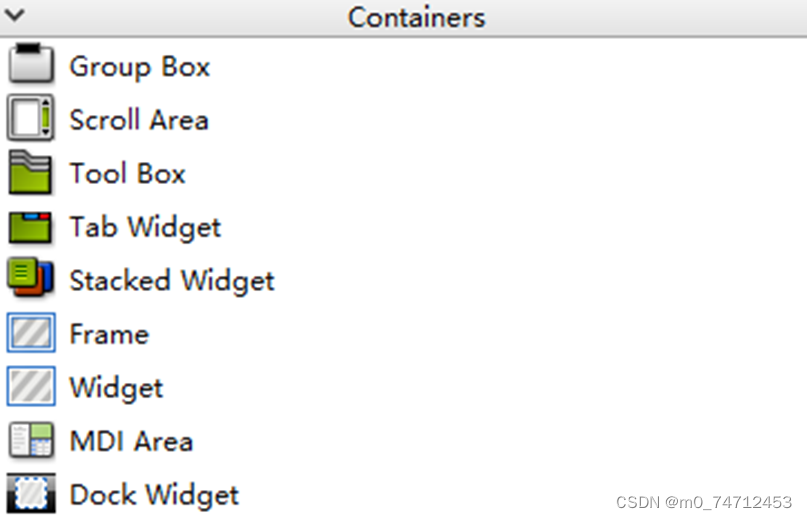

容器

- 组框

- 滚动区域

- 工具箱

- 选项卡窗口

- 堆窗口

- 框架

- 窗口(小部件)

- (Multiple Document Interface Area)多文档界面区域

- 停靠窗口(停靠小部件)