如何做婚恋网站武进网站建设信息

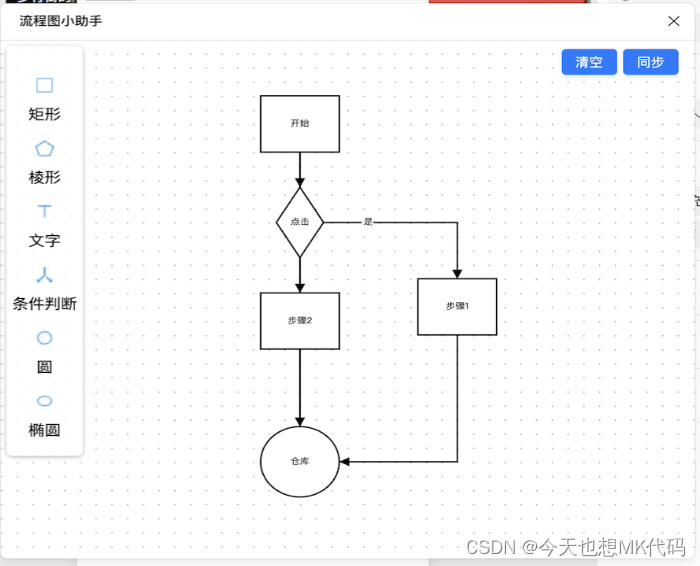

流程图小助手

更多内容

在设计工作中,流程图是一种重要的工具,它可以帮助设计师清晰地展示设计思路和流程,提升设计的条理性和逻辑性。今天,我们要向您推荐一款强大的设计工具,它可以帮助您轻松为设计稿设计流程图,让您的设计工作更具效率和准确性。接下来,让我们一起了解这款工具的功能及优势。

首先,这款工具提供了丰富的流程图元素和模板。无论是流程图、思维导图还是组织结构图,都可以轻松创建。您只需从预设的元素和模板中选择,即可快速设计出专业的流程图。

其次,这款工具支持拖拽和自动对齐功能,让您在设计流程图时更加方便快捷。您可以直接拖拽元素到画布上,工具会自动对齐和连接,大大提高了设计效率。

此外,这款工具支持实时预览和分享。在您设计流程图的过程中,可以随时查看预览,确保设计的准确性。完成设计后,还可以一键分享到团队或客户,方便协作和沟通。

最后,这款工具拥有简洁易用的操作界面,让您无需复杂的学习就能迅速上手。同时,工具还提供了详细的使用教程和示例,帮助您更好地掌握各种功能。

总之,这款设计流程图的工具凭借其强大的功能和便捷性,已经成为众多设计师的得力助手。快来试试这款工具,让您的设计稿更具条理和逻辑,为您的设计工作带来更多可能!