企业网站建设报价明细表洛阳霞光企业网站建设公司

mac有时候也出现一些问题,比如硬盘损坏。硬盘损坏会导致数据丢失、系统崩溃、性能下降等严重的后果,所以及时检测和修复硬盘损坏是非常必要的。那么,mac如何检测硬盘损坏呢?有哪些常用的mac硬盘检测坏道工具呢?

一、mac如何检测硬盘损坏

mac系统自带了一个名为“磁盘工具”的应用程序,可以用来检测和修复硬盘的一些问题。你可以通过以下步骤来使用“磁盘工具”:

1、打开“应用程序”文件夹,找到并双击“实用工具”文件夹,再找到并双击“磁盘工具”图标。

图1:磁盘工具

2、在“磁盘工具”的左侧栏中,选择你想要检测的硬盘或分区。

3、在“磁盘工具”的上方栏中,点击“急救”按钮。

4、在弹出的窗口中,点击“运行”按钮,开始检测硬盘。

图2:急救

5、等待检测完成后,查看结果。如果显示“操作成功”,则说明没有发现任何问题;如果显示“磁盘需要修复”,则说明发现了一些问题,需要进一步修复;如果显示“磁盘无法修复”,则说明问题很严重,可能需要更换硬盘。

图3:检测完成

6、如果需要修复硬盘,请点击“继续”按钮,并按照提示操作。请注意,在修复过程中,请不要关闭电源或中断操作,否则可能造成更大的损害。

二、常用mac硬盘检测坏道工具推荐

除了系统自带的“磁盘工具”外,还有一些第三方的软件可以用来检测和修复mac硬盘的坏道。坏道是指硬盘上无法读写或存储数据的区域,通常是由于物理损伤或老化造成的。坏道会影响硬盘的正常运行和数据安全,所以及时发现和处理坏道是非常重要的。

以下是一些常用的mac硬盘检测坏道工具推荐:

1、Tuxera NTFS for mac

这是一个专业的Mac NTFS格式驱动器读写软件,可以让你在mac上轻松访问和管理NTFS格式的存储设备。Tuxera NTFS for mac不仅提供了高速稳定的读写性能,还提供了一个名为Disk Manager的功能,可以让你在mac上对NTFS格式驱动器进行格式化、分区、检测和修复等操作。

Tuxera NTFS for mac 2023中文免费安装包下载:https://souurl.cn/IE35lO

Tuxera NTFS for mac激活码获取(永久使用):https://souurl.cn/kg02Ve

图4:Disk Manager

2、DriveDx

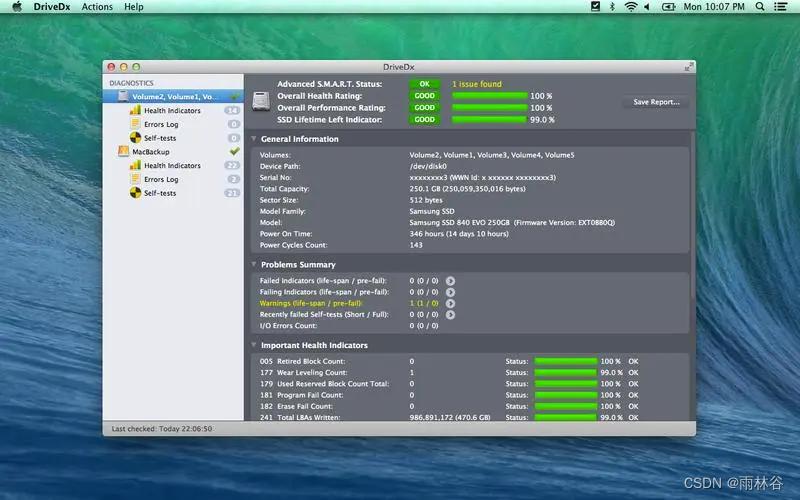

这是一个专业的mac硬盘健康监测和诊断软件,可以实时监控硬盘的温度、性能、寿命等指标,并提供详细的报告和建议。DriveDx还可以预警潜在的硬盘故障,并提供数据备份和恢复功能。DriveDx支持多种类型的硬盘和固态驱动器(SSD),并且有着简洁友好的用户界面。

图5:DriveDX

三、总结

本文介绍了mac如何检测硬盘损坏,以及常用mac硬盘检测坏道工具推荐。其中,“磁盘工具”是系统自带的应用程序,第三方工具有各自的特点和优势,你可以根据自己的需求选择合适的工具来保护你的mac硬盘和数据。希望本文对你有所帮助。