php网站开发招聘需求分析企业网站 论文

打造智能化休闲新体验

一、引言:智能化休闲时代的来临

随着科技的飞速发展,智能化、无人化服务逐渐渗透到我们生活的各个领域。在休闲娱乐行业,共享茶室棋牌室无人系统源码的出现,不仅革新了传统的休闲方式,更为消费者带来了全新的智能化休闲体验。

二、源码概述:智能科技的结晶

共享茶室棋牌室无人系统源码,是基于先进的人工智能和物联网技术开发的软件解决方案。该系统集成了用户管理、房间预定、自助支付、智能监控等多项功能,实现了茶室棋牌室的全天候无人化运营。

三、功能特点:便捷高效,安全舒适

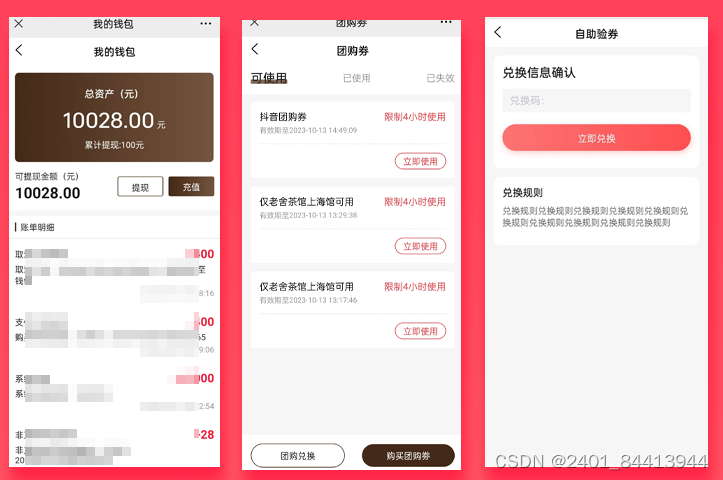

- 用户友好界面:简洁明了的操作界面,让消费者轻松上手,享受智能化服务的便捷。

- 智能预约系统:用户可通过手机APP或微信小程序进行房间预约,系统自动分配空闲房间,无需等待。

- 自助支付功能:支持多种支付方式,如微信支付、支付宝等,实现快速支付,提升消费体验。

- 智能监控与安全:系统实时监控室内情况,确保消费者安全,同时提供24小时在线客服支持,解决消费者疑虑。

四、应用前景:引领行业变革

共享茶室棋牌室无人系统源码的应用前景广阔。它不仅可以为传统茶室棋牌室提供智能化升级方案,还可以为酒店、度假村等场所提供定制化服务。随着技术的不断成熟和市场的不断拓展,该系统将引领休闲娱乐行业向更加智能化、无人化的方向发展。

五、结语:智能化,让生活更美好

共享茶室棋牌室无人系统源码的推出,不仅为消费者带来了全新的智能化休闲体验,也为休闲娱乐行业注入了新的活力。让我们共同期待智能化技术在更多领域的应用,让科技的力量为我们的生活带来更多便利与美好。