泰安做网站建设的公司哪家好广东省住房和城乡建设厅证件查询

GPT-5的即将到来:从高中生进化到,博士生?

随着近月GPT-4o的出世,OpenAI也在进行一系列的采访和介绍接下来的展望和目标。

在6月22日的采访中,美国达特茅斯工程学院公布了OpenAI首席技术官米拉·穆拉蒂的访谈内容。穆拉蒂确认,GPT-5将在一年半后发布,并描述了GPT-4到GPT-5的飞跃为高中生到博士生的成长。这一消息在科技界引起了广泛关注,引发了我们对人工智能(AI)未来发展的思考。那么作为GPT的使用者、创作者和面对者,我们应该如何看待这潘多拉魔盒呢?

从GPT-4到GPT-5:智能的飞跃

高中生到博士生的进化

穆拉蒂将GPT-4比作“聪明的高中生”,而将GPT-5比作“博士生”,这一类比形象地说明了两者在智能水平上的差距。GPT-4虽然在许多任务中表现出色,但它的智能水平依然有限。相较之下,我认为GPT-5将具备更高的理解能力、推理能力和专业知识储备,能够在特定任务上达到博士级别的智能——当然这是比喻的说法,但我认为如果官方能够有底气地说出这句话,那么很难不认同这次的升级是质的飞跃,是智的飞跃。

就如上次介绍4o的博文一样所说,4o的发布很有可能就是OpenAI放出的一个诱饵弹,是一个预兆也是一种告示,是对它的用户,对它的竞争对手——一年半之后,我GPT5将重磅袭来,将震动世界,GPT将引来进化。

这种进化从技术层面上意味着,GPT-5不仅仅是在数据处理和信息生成方面有所提升,还将能够更好地理解复杂的概念和上下文关系,从而在更多的应用场景中表现出色——这些都是以往的版本所不足的地方。例如,GPT-5可能在医学诊断、法律咨询和科学研究等领域展现出更强的能力,提供更加精准和有价值的建议和分析。

特定任务的突破

穆拉蒂强调,GPT-5的“博士级”智能仅适用于某些特定任务,并非全面超越人类智能。这一点非常重要,因为它提醒我们,尽管AI技术在不断进步,但它在许多方面仍然需要人类的监督和指导。

在某些特定任务上,GPT-5的智能水平可能达到甚至超过人类。例如,在自然语言处理、数据分析和模式识别等领域,GPT-5有望实现显著突破,帮助我们解决复杂问题,提高工作效率。然而,在需要创造性思维、情感理解和道德判断的任务中,AI仍然无法完全取代人类的作用。

GPT-5的潜在应用场景

那么GPT5的飞跃可能会出现在哪些地方呢?或者说它相对于之前的版本,都会有哪些提升呢?

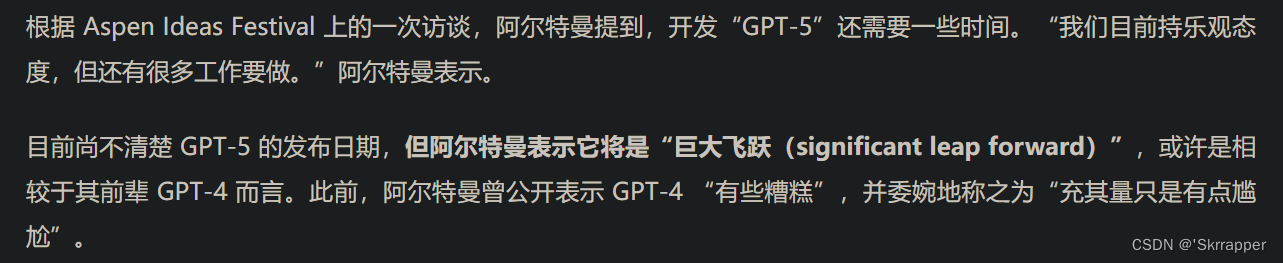

我们注意到奥特曼的采访中有一段话:

他表示GPT-4”有些糟糕“。实际上从我们用户的体验上来说,GPT-4已经能帮助我们解决很多冗杂、繁琐以及较为困难迅速解决的问题,它在用户的心中是不可取代的一个很高的地位。但是如果连CEO都说它实际上没那么好用——这其实可以看出潜台词:”下一代的GPT一定不会是类如GPT-4到GPT-4o那般的提升性进化,很有可能是从根本、从某些算法上改变GPT的运行模式,从而达到更好的使用体验,让它更好用——这个好用不仅仅指的是用GPT实现一些文本创造或者问题的回答——现在大部分用户也只是局限于这些作用。它会变得更加广泛,更加通用。

奥特曼进一步解释说:“我希望它能取得重大飞跃。GPT-4 经常犯很多错误,比如在推理方面表现不佳,有时还会完全跑偏,犯下低级错误,就像连一个六岁孩子都不会犯的一样。”

是的,这说明GPT5是在向着“不犯错误”这个绝对选项去的。

那么具体会落实到哪些方面进行提升呢?首先肯定是常规的各方面性能和准确率的提升。

文本创作能力提升

文本创作是人工智能的试金石,是看一个大模型是否好用的基本测试项目。GPT作为大模型的老大哥,在该方面定会有不小的提升。首先是对资源搜集的范围会更新到更新的日期,材料也会更权威,更科学。而输出的文笔、风格、提示词所摄取的信息以及输出,都必然会变得更加好用。

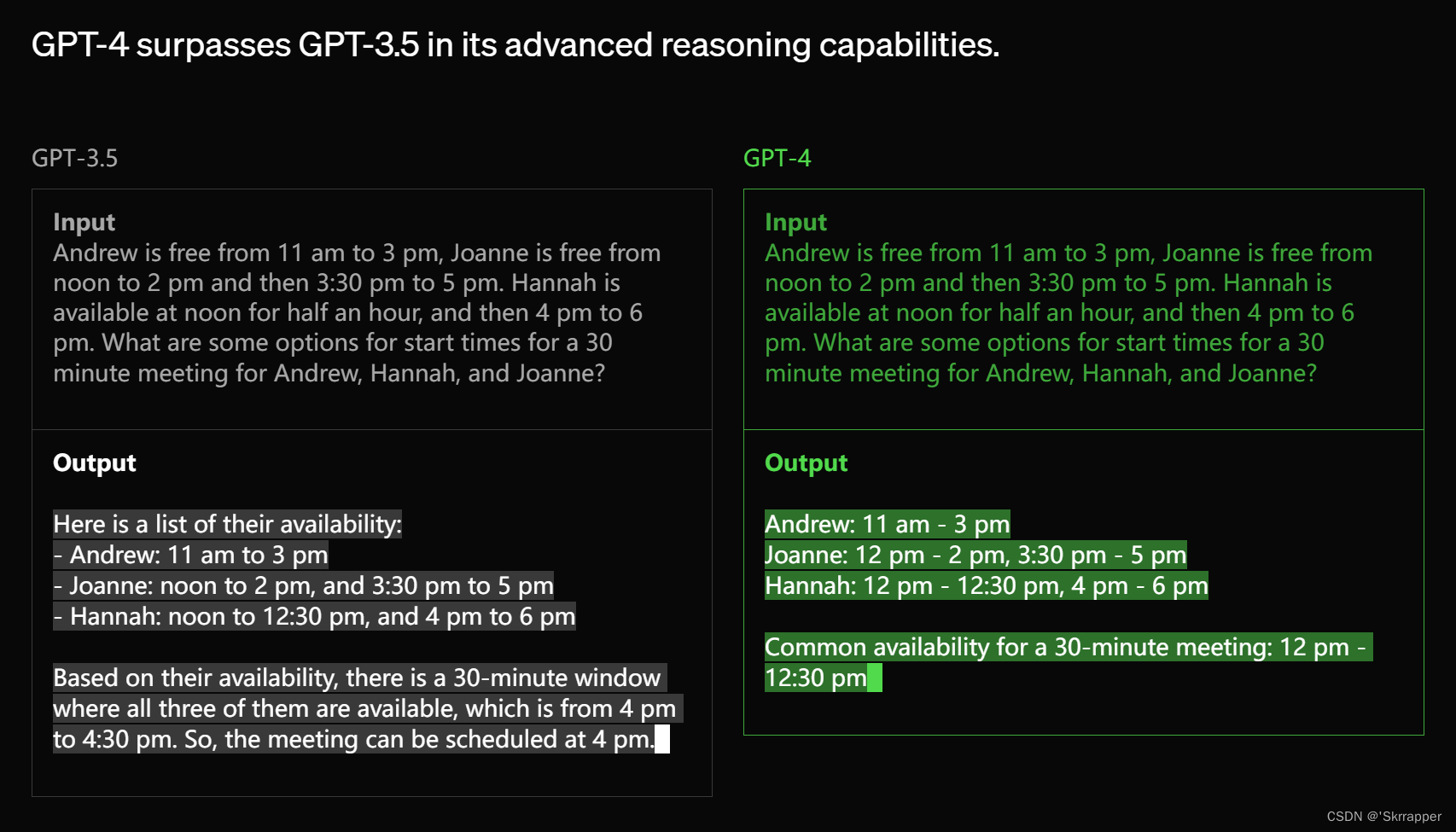

高级推理与专业知识

GPT-5有望在高级推理和专业知识的应用上实现飞跃。作为“博士生”,GPT-5将具备更强的逻辑推理能力和更深入的专业知识储备。这将使其在处理复杂问题和特定领域的任务时,表现得更加出色。例如,GPT-5可能在法律分析、科学研究和高等教育等领域,展现出无与伦比的智能和效率。

自主学习与适应能力

随着技术的发展,GPT-5预计将具备更强的自主学习和适应能力。通过不断吸收新的信息和知识,GPT-5可以快速适应变化的环境和任务需求。无论是在数据分析、自然语言处理,还是在情感理解和创造性思维方面,GPT-5都将展现出更高的灵活性和适应能力。

医疗健康

医疗健康是AI技术应用的一个重要领域。随着GPT-5的推出,我们可以期待它在医学诊断、病患咨询和医学研究等方面发挥更大的作用。

在医学诊断中,GPT-5可以帮助医生分析病患的病史、症状和实验结果,提供精准的诊断建议。这不仅可以提高诊断的准确性,还可以减轻医生的工作负担。在病患咨询方面,GPT-5可以通过自然语言处理技术,与病患进行互动,解答他们的疑问,提供健康建议,甚至在紧急情况下提供初步的医疗指导。

此外,GPT-5还可以在医学研究中发挥重要作用。它可以帮助研究人员分析大量的医学文献,识别出潜在的研究方向和趋势,加速新药的研发过程。通过对医学数据的深入分析,GPT-5可以帮助我们更好地理解疾病的机制,寻找新的治疗方法。

教育培训

教育领域是AI技术应用的另一个重要方向。GPT-5的智能提升将为教育培训带来新的可能性。

首先,GPT-5可以作为智能导师,帮助学生解决学习中的问题。它可以根据学生的学习进度和兴趣,提供个性化的学习建议和资源,帮助学生更有效地掌握知识。此外,GPT-5还可以通过与学生的互动,提供实时的反馈和指导,帮助他们克服学习中的难点。

其次,GPT-5可以帮助教师改进教学方法。它可以分析学生的学习数据,识别出教学中的薄弱环节,提供改进建议。通过对教学内容的优化,GPT-5可以帮助教师提高教学效果,提升学生的学习体验。

最后,GPT-5还可以在职业培训中发挥作用。它可以根据学员的职业需求,提供定制化的培训课程,帮助他们掌握新的技能,提升职业竞争力。无论是在学校教育还是职业培训中,GPT-5都有望成为一种强大的辅助工具。

商业和金融

在商业和金融领域,GPT-5的应用前景同样广阔。随着智能化水平的提升,GPT-5将能够在数据分析、市场预测和客户服务等方面发挥重要作用。

在数据分析方面,GPT-5可以帮助企业处理和分析海量的商业数据,识别出市场趋势和机会。通过对历史数据的深入分析,GPT-5可以为企业提供精准的市场预测,帮助他们制定更加科学的商业策略。

在客户服务方面,GPT-5可以通过自然语言处理技术,与客户进行互动,提供及时的解答和帮助。无论是在电话客服还是在线客服中,GPT-5都可以通过模拟人类的对话方式,提供高质量的服务,提升客户满意度。

此外,GPT-5还可以在金融领域发挥重要作用。它可以帮助金融机构分析市场数据,识别出投资机会,提供投资建议。通过对金融数据的深入分析,GPT-5可以帮助投资者做出更加科学的投资决策,降低投资风险。

面对GPT-5——是谁?如何交往?

随着届时GPT-5的推出,我们必然会提高与人工智能AI的交往。与人交流很难,需要很多的规则和规范。而与人工智能,同样也不简单。GPT5更加聪明,它也更加有可能能够通过足够广的知识面猜测到人类的思维模式和形式。这使得我们能够更好地去使用它,但是同时也会带来一问题:AI系统可能被恶意利用,幕后的人类使用AI进行诈骗、窃取等违法操作。因此,我们需要制定严格的法律法规,加强对AI技术的监管,确保其安全性和可靠性。

在GPT-5时代,人机协作将会更加普遍。但你要记住是人机协作而不是人人合作。这是前所未有的——对比上个年代,这不是简单的人类与机器,或者更详细的是人类与计算机,这是人工智能。这种技术上的协作实际上还有很多需要拓展和研究的点。我们需要从严对待,正确使用。

GPT-5发布将对社会产生深远的影响。一方面,它将带来新的就业机会和经济增长点;另一方面,它也可能导致一些传统岗位的消失。因此,我们需要制定相应的政策,帮助劳动者适应新的工作环境,提升他们的职业技能。

前几日,OpenAI同时也发布了一个惊人的消息:GPT的API服务将停止对中国开放。很难说这与一年半后的GPT5发布无关——尽管这有些过于勉强。针对当前的环境,这种措施似乎似曾相识当年的华为。我们只有不断努力,在人工智能和机器学习的路上做出更多成绩,才有可能不对国外的技术如此依赖。

当哪一天GPT-5或者Claude新版本的发布不再让国人如此惊讶和关注,而是更在意如何提升国内AI大模型的准确度和效率时,这是或许才会在AI世界看到大同的趋势和迹象。

“百尺竿头须进步”,在GPT-5到来的前后,愿我们能共同进步,无限提升。